Ordinary Differential Equations

معادلهی دیفرانسیل معمولی

معادلاتی به شکل زیر:

$F(x, y, y^{\prime}, y^{\prime \prime}, ..., y^{(n)})$

یعنی معادلاتی که در آنها تابع مجهول وای:

$y = f(x)$

به همراه یک یا چند مشتق مراتب مختلف آن و همچنین به احتمال متغیر مستقل ایکس وجود دارد، معادلات دیفرانسیل معمولی گفته میشود.

چند مثال:

$y^{\prime \prime} - 3 y^{\prime} + x y = y^2$

$y^{\prime} + y = 0$

$4y^{(5)} - y + x = 0$

اما مثال زیر یک معادلهی دیفرانسیل نیست:

$2y - y^2 = 0$

حل کردن یک معادلهی دیفرانسیل یعنی پیدا کردن تابع مجهول وای.

مرتبهی معادلهی دیفرانسیل

بالاترین مرتبهی مشتق ظاهر شده در معادلهی دیفرانسیل را مرتبهی معادلهی دیفرانسیل میگویند.

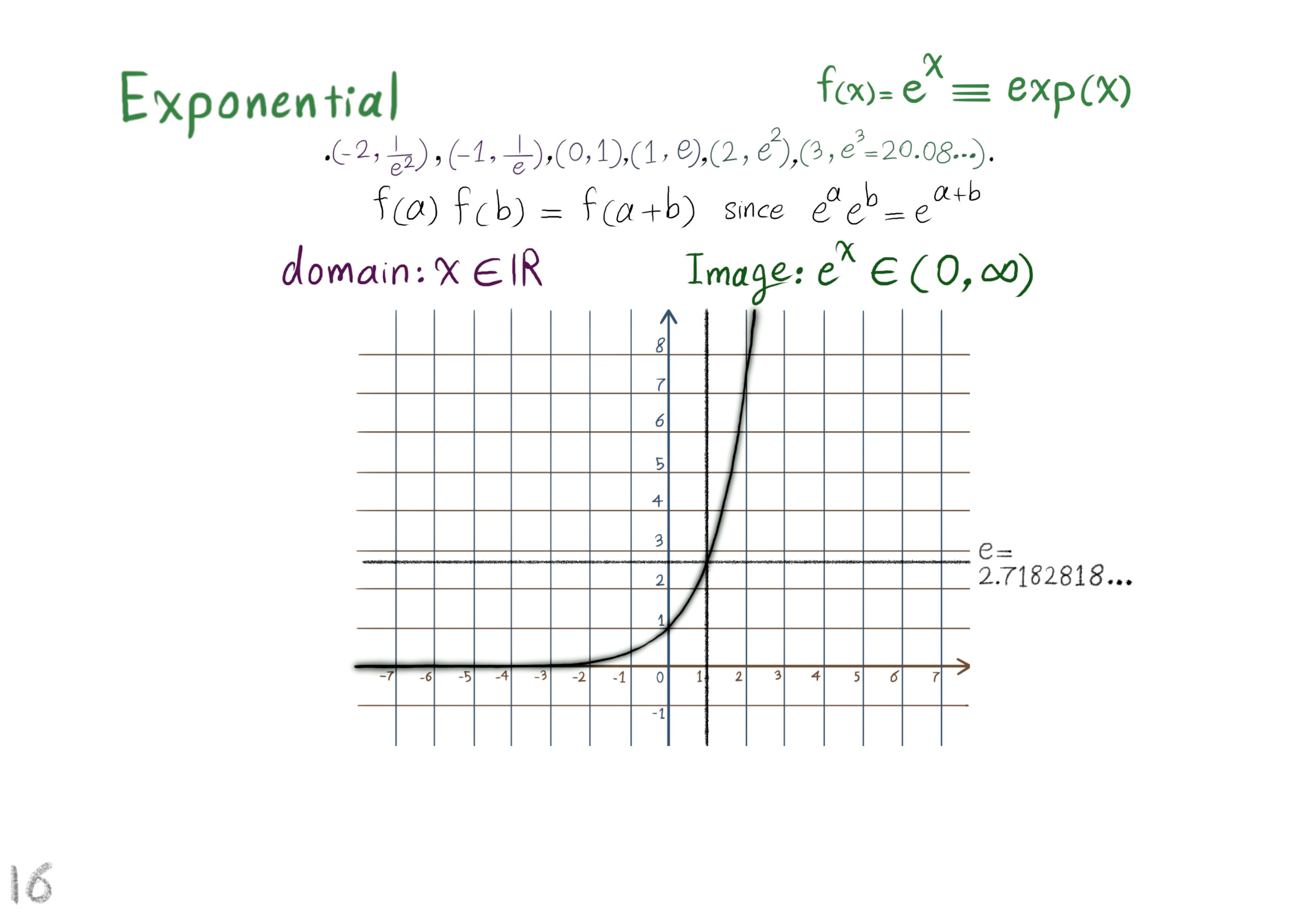

حل چند مثال ساده

- $y^{\prime} = 3$,

$y = 3x + c$.

- $y^{\prime} - y = 0$,

$y^{\prime} = y$,

$y = ce^x$.

- $y^{\prime} = e^x$,

$y = e^x + c$.

- $y^{\prime} = 4e^x$,

$y = 4e^x$.

یادآوری ریاضی عمومی:

$(e^u)^{\prime} = u^{\prime} e^u$.

$(e^x)^{\prime} = 1 e^x = e^x$,

$(kf)^{\prime} = kf^{\prime}$.

چون تنوع معادلات دیفرانسیل زیاد است، آنها را در چند نوع طبقهبندی میکنند و برای هر کدام روش حل ارایه میشود. انواع معادلات دیفرانسیل معمولی مرتبهی اول: جداشدنی، کامل، همگن، خطی با ضرایب ثابت، برنولی و ریکاتی. مجهول ما در معادله، وای برابر با تابعی از ایکس میباشد.

معادلهی دیفرانسیل جداشدنی (تفکیک پذیر)

اگر معادلهی دیفرانسیل را بتوان به شکل زیر نوشت:

$f(y) \ dy = f(x) \ dx$

اف ایکس تابعی به طور تمام بر حسب ایکس است و اف وای تابعی به طور تمام بر حسب وای است. میگوییم این معادله جدا شده است و برای حل کردن آن از دو طرف انتگرال میگیریم.

مثال

$y^{\prime} = \frac{2x}{3y^2} \longrightarrow \frac{dy}{dx} = \frac{2x}{3y^2} \longrightarrow 3y^2 \ dy = 2x \ dx$,

$\int 3y^2 \ dy = \int 2x \ dx \longrightarrow y^3 = x^2 + c \longrightarrow y = \sqrt[3]{x^2 + c}$.

مثال

$y^{\prime} = e^{x + y} \longrightarrow \frac{dy}{dx} = e^x \ e^y \longrightarrow \frac{dy}{e^y} = e^x \ dx$,

$e^{-y} \ dy = e^x \ dx \longrightarrow \int e^{-y} \ dy = \int e^x \ dx \longrightarrow -e^{-y} = e^x + c$,

$e^{-y} = c - e^x \longrightarrow ln(e^{-y}) = ln(c - e^x) \longrightarrow -y = ln(c - e^x)$,

$y = -ln(c - e^x)$.

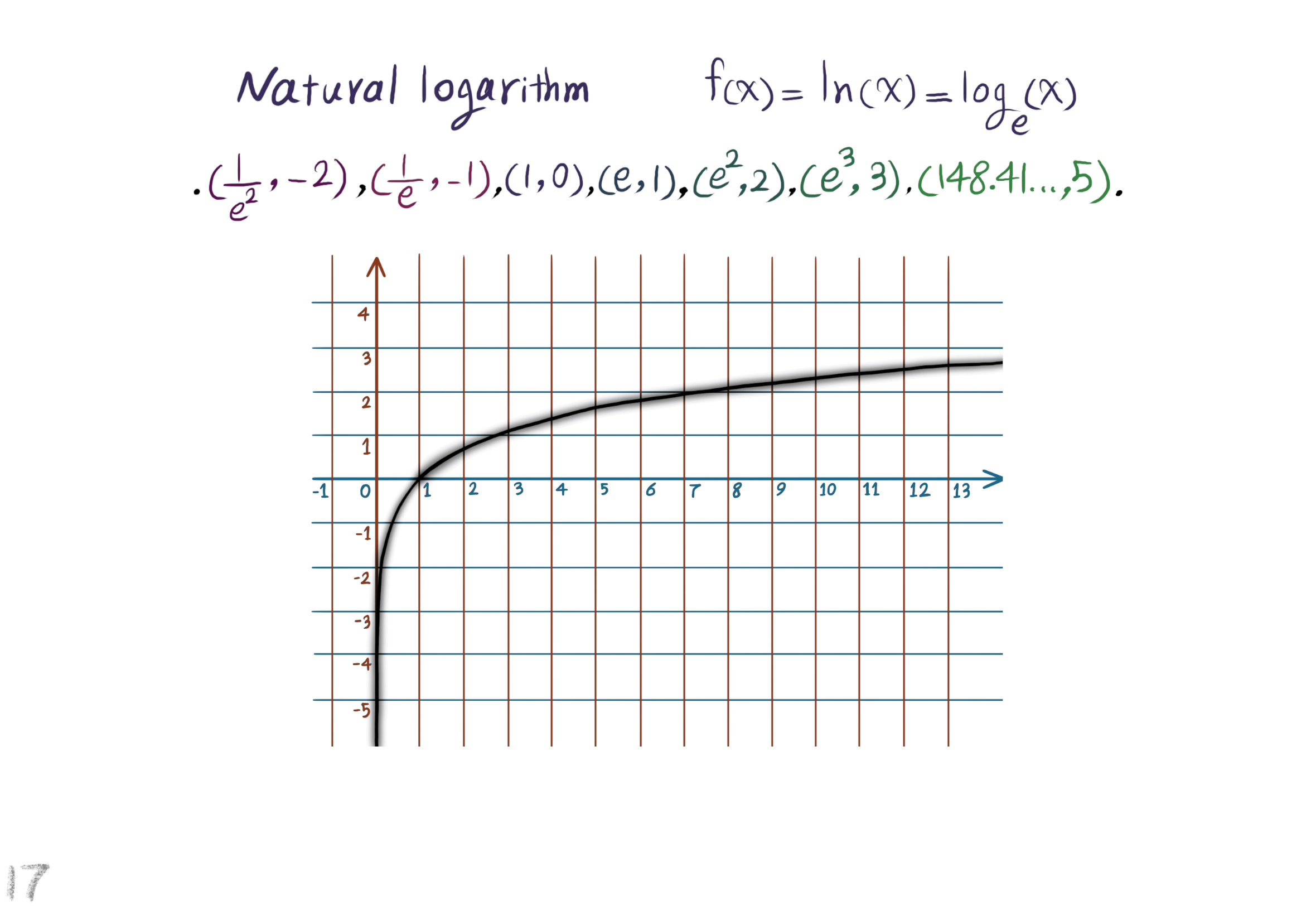

یادآوری دربارهی لگاریتم طبیعی

$ln(x) = log_e^x$,

$ln(7) = log_e^7 = 1.94591014906 \longrightarrow e^{1.94591014906} = 7$,

$log_a^b = log_a^b$,

$a^{log_a^b} = b$,

$ln(e^{-y}) = log_e^{e^{-y}}$.

خاصیت لگاریتم طبیعی

$log_a^{b^n} = n \ log_a^b$,

$log_e^{e^{-y}} = -y \ log_e^e = -y$.

روش تغییر متغیر برای حل کردن انتگرال تابع نمایی

$\int e^{-y}$

$u = -y \longrightarrow du = -dy \longrightarrow -\int e^u \ du = -e^u = -e^{-y}$.

مثال

معادلهی دیفرانسیل جداشدنی زیر را حل کنید.

$sec^2(x) \ tan(y) \ dx + sec^2(y) \ tan(x) \ dy = 0$

$sec(x) = \frac{1}{cos(x)}$

$sec^2(x) \ tan(y) \ dx = -sec^2(y) \ tan(x) \ dy$

$\frac{sec^2(x) dx}{tan(x)} = \frac{-sec^2(y) dy}{tan(y)}$

$\int \frac{sec^2(x)}{tan(x)} dx = -\int \frac{sec^2(y)}{tan(y)} dy \longrightarrow ln|tan(x)| = -ln|tan(y)| + c$

$\int \frac{u^{\prime}}{u} du = ln|u| + c$

$(tan(x))^{\prime} = sec^2(x)$

$(tan(u))^{\prime} = u^{\prime} (1 + tan^2(u)) \longrightarrow (tan(x))^{\prime} = 1 + tan^2(x)$

$1 + tan^2(x) = 1 + \frac{sin^2(x)}{cos^2(x)} = \frac{cos^2(x) + sin^2(x)}{cos^2(x)} = \frac{1}{cos^2(x)} = sec^2(x)$

$ln|tan(x)| + ln|tan(y)| = c \longrightarrow ln|tan(y)| = c - ln|tan(x)|$

$ln|tan(x) \ tan(y)| = c \longrightarrow e^{ln|tan(x) \ tan(y)|} = e^c$

$tan(x) \ tan(y) = e^c \longrightarrow tan(y) = \frac{e^c}{tan(x)} \longrightarrow y = tan^{-1} (\frac{e^c}{tan(x)})$.

معادلات دیفرانسیل کامل

معادلاتی هستند به شکل کلی زیر:

$M(x, y) \ dx + N(x, y) \ dy = 0$

به شرطی که:

$\frac{\partial M}{\partial y} = \frac{\partial N}{\partial x}$.

برای حل کردن این دسته از معادلات فرض میکنیم که اف ایکس و وای جواب معادله باشد و قرار میدهیم:

$f(x, y) = \int M(x, y) \ dx + h(y)$

که در اینجا ایچ وای تابعی به طور تمام بر حسب وای است. در ادامه، مقدار مشتق جزیی تابع اف نسبت به متغیر وای را به دست میآوریم و قرار میدهیم:

$N(x, y) = \frac{\partial f(x, y)}{\partial y}$

از این راه، تابع ایچ وای را به دست میآوریم و در آخر تابع اف ایکس و وای را به طور تمام به دست میآوریم.

مثال

معادلهی دیفرانسیل کامل زیر را حل کنید.

$(x + y + 1) dx + (x - y^2 + 3) dy = 0$

$\left\{ \begin{array}{l} M(x, y) = x + y + 1 &\\ N(x, y) = x - y^2 + 3 \end{array} \right.$

$\left\{ \begin{array}{l} \frac{\partial M(x, y)}{\partial y} = 1 &\\ \frac{\partial N(x, y)}{\partial x} = 1 \end{array} \right.$

$f(x, y) = \int (x + y + 1) dx + h(y) = \frac{x^2}{2} + y x + x + c + h(y)$

$\frac{\partial f(x, y)}{\partial y} = x + h^{\prime}(y)$

$x + h^{\prime}(y) = x - y^2 + 3 \longrightarrow h^{\prime}(y) = x - y^2 + 3 - x$

$h(y) = \int (-y^2 + 3) dy = \frac{-y^3}{3} + 3y$

$f(x, y) = \frac{x^2}{2} + yx + x - \frac{y^3}{3} + 3y + c$.

مثال

معادلهی دیفرانسیل کامل زیر را حل کنید.

$(2x^2 + 2xy^2 + 4y) dx + (2x^2y + 4x + 5y^4) dy = 0$

$\left\{ \begin{array}{l} M(x, y) = 2x^2 + 2xy^2 + 4y &\\ N(x, y) = 2x^2y + 4x + 5y^4 \end{array} \right.$

$\left\{ \begin{array}{l} \frac{\partial M(x, y)}{\partial y} = 4xy + 4 &\\ \frac{\partial N(x, y)}{\partial x} = 4xy + 4 \end{array} \right.$

$f(x, y) = \int (2x^2 + 2xy^2 + 4y) dx + h(y)$

$f(x, y) = \frac{2}{3} x^3 + x^2y^2 + 4yx + c + h(y)$

$N(x, y) = \frac{\partial f}{\partial y} = \frac{\partial}{\partial y} (\frac{2}{3} x^3 + x^2y^2 + 4yx + c + h(y))$

$N(x, y) = 2x^2y + 4x + h^{\prime}(y) = 2x^2 y + 4x + 5y^4$

$h^{\prime}(y) = 2x^2 y + 4x + 5y^4 - 4x - 2x^2y = 5y^4$

$h(y) = \int h^{\prime}(y) dy = \int 5y^4 dy = y^5 + c$

$f(x, y) = \frac{2}{3} x^3 + x^2y^2 + 4yx + y^5 + c$.

تعریف تابع همگن

تابع اف ایکس و وای را همگن از درجهی ان (ان عضوی از اعداد صحیح) میگویند، هرگاه عدد غیر صفری مانند تی وجود داشته باشد، به طوری که:

$f(tx, ty) = t^n f(x, y)$,

$n \in \mathbb{Z}$,

$t \neq 0$.

مثال

تابع اف ایکس و وای که با ضابطهی زیر تعریف شده است یک تابع همگن از درجهی چند است؟

$f(x, y) = x^4 - x^3 y$

$f(tx, ty) = (tx)^4 - (tx)^3 (ty) = t^4 x^4 - t^3 x^3 t y = t^4 x^4 - t^4 x^3 y = t^4 (x^4 - x^3 y) = t^4 f(x, y)$

$n = 4$

پس تابع اف ایکس و وای یک تابع همگن از درجهی چهار است.

معادلات دیفرانسیل مرتبهی اول همگن

معادلاتی به فرم زیر هستند:

$M(x, y) dx + N(x, y) dy = 0$

به طوری که تابعهای ام و ان همگن هستند.

روش حل: با تغییر متغیر زیر، معادله را به یک معادلهی جداشدنی تبدیل میکنیم و سپس آن را حل میکنیم.

$u = \frac{y}{x}$

مثال

معادلهی دیفرانسیل همگن زیر را حل کنید.

$y^{\prime} = 1 + \frac{y}{x}$

$y^{\prime} = \frac{x + y}{x}$

واضح است که ام و ان تابعهایی همگن از درجهی یک هستند. پس از روش تغییر متغیر استفاده میکنیم.

$M(tx, ty) = tx + ty = t(x + y) = t^1 M(x, y)$

$\left\{ \begin{array}{l} M(x, y) dx = N(x, y) dy &\\ (x + y) dx = (x) dy \end{array} \right.$

$y = ux \longrightarrow dy = x \ du + u \ dx$

$(x + ux) dx - x(x \ du + u \ dx) = 0$

$x \ dx + u x \ dx - x^2 \ du - x u \ dx = 0$

$x \ dx = x^2 \ du \longrightarrow \frac{1}{x} dx = du$

معادله بر حسب متغیرهای ایکس و وای تفکیک شد. حالا از دو طرف معادله انتگرال میگیریم تا به تابع مجهول وای بر حسب متغیر ایکس برسیم.

$\int \frac{1}{x} dx = \int du$,

$ln(x) = u + c \longrightarrow ln(x) = \frac{y}{x} + c \longrightarrow ln(x) = \frac{y + cx}{x}$,

$y = x \ ln(x) - cx$.

مثال

معادلهی دیفرانسیل همگن زیر را حل کنید.

$(x e^{\frac{y}{x}} + y) dx - x \ dy = 0$.

$y = ux \longrightarrow dy = x \ du + u \ dx \longrightarrow (x e^u + ux) dx - x (x \ du + u \ dx) = 0$

$x e^u \ dx + ux \ dx - x^2 \ du - xu \ dx = 0$

$x e^u \ dx = x^2 \ du \longrightarrow \frac{1}{x} dx = e^{-u} du$

$\int \frac{1}{x} dx = \int e^{-u} du \longrightarrow ln(x) = -e^{-u} + c$

$ln(x) = -e^{-\frac{y}{x}} + c$

$ln(c - ln(x)) = ln(e^{-\frac{y}{x}}) \longrightarrow ln(c - ln(x)) = -ln(e^{\frac{y}{x}}) \longrightarrow -ln(c - ln(x)) = \frac{y}{x}$

$y = -x \ ln(c - ln(x))$.

یادآوری

$log_b^a = log_b^a$,

$b^{log_b^a} = a$,

$log_e^{e^y} = y \ log_e^e = y$.

معادلهی دیفرانسیل خطی مرتبهی اول

حل کردن معادلهی دیفرانسیل خطی مرتبهی اول به فرم زیر

$y^{\prime} + p(x) y = q(x)$

که تابع پی و تابع کیو، تابعهایی پیوسته و بر حسب ایکس هستند. جواب این معادله به صورت زیر است:

$y = \frac{1}{e^{\int p(x)dx}}(\int e^{\int p(x)dx} q(x)dx + c)$

مثال

معادلهی خطی مرتبهی اول زیر را حل کنید.

$y^{\prime} + y = e^x$

$\left\{ \begin{array}{l} p(x) = 1 &\\ q(x) = e^x \end{array} \right.$

$\int p(x) dx = \int dx = x + c$

$y = \frac{1}{e^{x + c}} (\int e^{x + c} e^x dx + c)$

$y = \frac{1}{e^{x + c}} (\int e^{2x + c} dx + c) = \frac{1}{e^{x + c}} (\frac{e^{2x + c}}{2} + c)$

$y = \frac{e^x}{2} + ce^{-x - c}$

$y = \frac{1}{e^x} (\frac{1}{2} e^{2x} + c)$.

مثال

$y^{\prime} + \frac{2x}{1 + x^2} y = \frac{cot(x)}{1 + x^2}$

$\left\{ \begin{array}{l} p(x) = \frac{2x}{1 + x^2} &\\ q(x) = \frac{cot(x)}{1 + x^2} \end{array} \right.$

فرم کلی معادلات خطی:

$y^{\prime} + p(x) y = q(x)$

$e^{\int p(x) dx} = e^{\int \frac{2x}{1 + x^2} dx} = e^{\int \frac{du}{u}} = e^{ln|u|} = u$.

$e^{\int p(x) dx} = u = 1 + x^2$

$y = \frac{1}{1 + x^2} (\int q(x) e^{\int p(x) dx} dx + c)$

$y = \frac{1}{1 + x^2} (\int \frac{cot(x)}{1 + x^2} (1 + x^2) dx + c)$

$y = \frac{1}{1 + x^2} (\int cot(x) dx + c) = \frac{1}{1 + x^2} (ln(|sin(x)|) + c)$

یادآوری

$\int cot(x) dx = \int \frac{cos(x)}{sin(x)} dx = ln|sin(x)| + c$.

معادلات برنولی

معادلاتی هستند به فرم

$y^{\prime} + p(x) y = q(x) y^n$.

در حالتی که ان برابر با صفر باشد و در حالتی که ان برابر با یک باشد، معادلات برنولی همان معادلات خطی مرتبهی اول هستند.

$n = 0, n = 1$

بنابراین، این معادلات را در حالتی که ان نابرابر با صفر ونابرابر با یک است، حل میکنیم.

$n \neq 0, n \neq 1$

روش حل: برای حل معادلات برنولی، ابتدا طرفین معادله را بر وای به توان ان تقسیم میکنیم.

$/ y^n$

و سپس با تغییر متغیر زیر، معادله را به یک معادلهی خطی مرتبهی اول بر حسب ایکس و یو تبدیل میکنیم و بعد آن راحل میکنیم.

$u = \frac{1}{y^{n - 1}}$

مثال

معادلهی برنولی زیر را حل کنید.

$y^{\prime} + \frac{1}{x} y = y^2$

حل: تقسیم دو طرف معادله بر وای به توان ان:

$n = 2 \longrightarrow y^n = y^2$

$\frac{y^{\prime}}{y^2} + \frac{1}{xy} = 1$

تغییر متغیر

$\left\{ \begin{array}{l} u = \frac{1}{y} = y^{-1} &\\ du = d(y^{-1}) = -y^{-2} dy \end{array} \right.$

معادله را بر حسب متغیر یو بازنویسی میکنیم.

$\frac{y^{\prime}}{y^2} + \frac{1}{x} \frac{1}{y} = 1$

$y^{\prime} u^2 + \frac{u}{x} = 1$

$\left\{ \begin{array}{l} -du = dy \ y^{-2} &\\ u^{\prime} = - y^{\prime} y^{-2} \end{array} \right.$

$-u^{\prime} + \frac{u}{x} = 1$

$u^{\prime} - \frac{u}{x} = -1 \longrightarrow u^{\prime} - \frac{u}{x} + 1 = 0$

معادله خطی مرتبهی اول بر حسب متغیرهای یو و ایکس است.

$\left\{ \begin{array}{l} p(x) = \frac{-1}{x} &\\ q(x) = -1 \end{array} \right.$

$e^{\int p(x) dx} = e^{\int -\frac{1}{x} dx} = e^{-ln|x|} = \frac{1}{x}$

$u = \frac{1}{e^{\int p(x) dx}} (\int q(x) e^{\int p(x) dx} dx + c)$

$u = x (\int (-1) \frac{1}{x} dx + c) = x(\int -\frac{1}{x} dx + c)$

$u = x (-ln|x| + c)$

$u = \frac{1}{y}$

$y^{-1} = u = x(-ln|x| + c) \longrightarrow y = \frac{1}{x(-ln|x| + c)}$.

یادآوری

به طور کلی متغیر وای عبارتیست بر حسب متغیر ایکس.

$(y^n)^{\prime} = n y^{\prime} y^{n - 1}$

در حالت خاص

$y = x \longrightarrow (x^n)^{\prime} = n x^{\prime} x^{n - 1}$.

تمرینهای دورهای

تمرین معادلهی جداشدنی

- $y^\prime = \frac{5x}{2y^2}$

$\frac{dy}{dx} = \frac{5x}{2y^2} \longrightarrow 5x \ dx = 2y^2 \ dy$

$\int 5x \ dx = \int 2y^2 \ dy \longrightarrow \frac{5x^2}{2} = \frac{2y^3}{3} + c$

$\frac{2y^3}{3} = \frac{5x^2}{2} + c \longrightarrow y^3 = \frac{3}{2} (\frac{5x^2}{2} - c)$

$y = \sqrt[3]{\frac{3}{2} (\frac{5x^2}{2} - c)}$.

- $xy^\prime + y = y^2$

$x \frac{dy}{dx} + y = y^2 \longrightarrow \frac{x}{dx} + \frac{y}{dy} = \frac{y^2}{dy}$

$\frac{x}{dx} = \frac{y^2}{dy} - \frac{y}{dy} \longrightarrow \frac{x}{dx} = \frac{y^2 - y}{dy}$

$\frac{dx}{x} = \frac{dy}{y^2 - y} \longrightarrow \frac{dx}{x} = \frac{dy}{y (y - 1)}$

$\frac{dx}{x} = dy (\frac{A}{y} + \frac{B}{y - 1}) \longrightarrow \frac{dx}{x} = \frac{-dy}{y} + \frac{dy}{y - 1}$

$\frac{A (y - 1) + B y}{y (y - 1)} = \frac{1}{y (y - 1)}$

$Ay - A + By = 1$

$\left\{ \begin{array}{l} A + B = 0 &\\ -A = 1 \end{array} \right.$

$\left\{ \begin{array}{l} A = -1 &\\ B = 1 \end{array} \right.$

$\int \frac{dx}{x} = - \int \frac{dy}{y} + \int \frac{dy}{y - 1} \longrightarrow ln|x| = -ln|y| + ln|y - 1| + c$

$ln|x| = ln|\frac{y - 1}{y}| + c \longrightarrow e^{ln|x|} = e^{ln|\frac{y - 1}{y}| + c} \longrightarrow x = \frac{y - 1}{y} + c_1$

$x = 1 - \frac{1}{y} + c_1 \longrightarrow \frac{1}{y} = 1 - x + c_1$

$y = \frac{1}{1 - x + c_1}$.

تمرین معادلهی همگن

- $(x^2 + y^2) dx + 2xy \ dy = 0$

$u = \frac{y}{x} \longrightarrow y = ux \longrightarrow dy = u \ dx + x \ du$

$(x^2 + u^2 x^2) dx + 2x ux \ dy = 0$

$x^2 (u^2 + 1) dx + 2x^2 u \ dy = 0 \longrightarrow x^2 (u^2 + 1) dx + 2x^2 u (u \ dx + x \ du) = 0$

$(u^2 + 1) dx + 2u^2 \ dx + 2ux \ du = 0$

$dx(u^2 + 1 + 2u^2) + 2ux \ du = 0 \longrightarrow (3u^2 + 1) dx + 2ux \ du = 0$

$\frac{3u^2 + 1}{x} dx + 2u \ du = 0 \longrightarrow \frac{dx}{x} + \frac{2u}{3u^2 + 1} du = 0$

$\frac{dx}{x} = \frac{-2u}{3u^2 + 1} du \longrightarrow \int \frac{dx}{x} = \int \frac{-2u}{3u^2 + 1} du$

$ln|x| = \frac{-1}{3} \int \frac{2u}{u^2 + 1} du \longrightarrow ln|x| = \frac{-1}{3} ln|u^2 +1| + c$

$e^{ln|x|} = e^{\frac{-1}{3} ln|u^2 + 1| + c}$

$x = e^{ln|(u^2 + 1)^{\frac{-1}{3}}| + c} \longrightarrow x = \frac{1}{\sqrt[3]{u^2 + 1}} + c_1$

$\frac{1}{x} = \sqrt[3]{u^2 + 1} + c_1 \longrightarrow \frac{1}{x^3} = u^2 + 1 + c_1$

$u^2 = \frac{1}{x^3} - 1 - c_1 \longrightarrow u = \sqrt{\frac{1}{x^3} - 1 - c_1}$

$\frac{y}{x} = \sqrt{\frac{1}{x^3} - 1 - c_1}$

$y = x \sqrt{\frac{1}{x^3} - 1 - c_1}$.

- $y^\prime = 2 + \frac{y}{x}$

$u = \frac{y}{x} \longrightarrow y = ux \longrightarrow dy = u \ dx + x \ du$

$\frac{dy}{dx} = u + x \frac{du}{dx} \longrightarrow y^\prime = u + x u^\prime$

$u + xu^\prime = 2 + u \longrightarrow x u^\prime = 2 \longrightarrow u^\prime = \frac{2}{x}$

$\frac{du}{dx} = \frac{2}{x} \longrightarrow du = \frac{2 dx}{x}$

$\int du = \int 2 \frac{dx}{x} \longrightarrow u = 2 ln|x| + c$

$\frac{y}{x} = ln(x^2) + c \longrightarrow y = x \ ln(x^2) + cx$.

تمرین معادلهی کامل

- $(x + y + 2) dx + (x - y^2 + 1) dy = 0$

$f(x, y) = \int (x + y + 2) dx + h(y) = \frac{x^2}{2} + xy + 2x + c + h(y)$

$\frac{\partial f}{\partial y} = N(x, y)$

$x + h^\prime (y) = x - y^2 + 1 \longrightarrow h^\prime (y) = \int h(y) dy = \int (1 - y^2) dy = y - \frac{y^3}{3} + c_1$

$f(x, y) = \frac{x^2}{2} + xy + 2x + y - \frac{y^3}{3} + c_2$.

- $(2x^2 + 4y) dx + (4x - 3y^2) dy = 0$

$f(x, y) = \int M(x, y) dx + h(y) \longrightarrow f(x, y) = \int (2x^2 + 4y) dx + h(y) = \frac{2x^3}{3} + 4xy + h(y)$

$\frac{\partial f(x, y)}{\partial y} = N(x, y) \longrightarrow 4x + h^\prime (y) = 4x - 3y^2 \longrightarrow h^\prime (y) = -3y^2$

$h(y) = \int h^\prime (y) dy \longrightarrow h(y) = \int -3y^2 \ dy \longrightarrow h(y) = -3 \frac{y^3}{3} + c \longrightarrow h(y) = -y^3 + c$

$f(x, y) = \frac{2}{3} x^3 + 4xy - y^3 + c$.

- $(2xe^y + e^x) dx + (x^2 + 1) e^y dy = 0$

$f(x, y) = \int M(x, y) dx + h(y) = \int (2xe^y + e^x) dx + h(y) = \frac{2x^2}{2} e^y + e^x + c + h(y)$

$\frac{\partial f(x, y)}{\partial y} = N(x, y) \longrightarrow x^2 e^y + h^\prime (y) = e^y (x^2 + 1)$

$h^\prime (y) = e^y (x^2 + 1) - x^2 e^y = e^y x^2 + e^y - e^y x^2 = e^y$

$h(y) = \int h^\prime (y) dy = \int e^y dy = e^y + c_1$

$f(x, y) = x^2 e^y + e^x + e^y + c_2$

تمرین معادلهی خطی مرتبه اول

- $\frac{dy}{dx} + y = e^x$

$\left\{ \begin{array}{l} p(x) = 1 &\\ q(x) = e^x \end{array} \right.$

$\int p(x) dx = \int dx = x$

$y = \frac{1}{e^{\int p(x) dx}} (\int e^{\int p(x) dx} q(x) dx + c)$

$y = \frac{1}{e^x} (\int e^x e^x dx + c) \longrightarrow y = e^{-x} (\int e^{2x} dx + c)$

$y = e^{-x} (\frac{e^{2x}}{2} + c) \longrightarrow y = \frac{e^x}{2} + c e^{-x}$.

- $\frac{dy}{dx} = \frac{e^{2y}}{xe^{2y} - y}$

$\frac{dx}{dy} = \frac{x e^{2y} - y}{e^{2y}} = \frac{x e^{2y}}{e^{2y}} - \frac{y}{e^{2y}}$

$\frac{dx}{dy} = x - \frac{y}{e^{2y}} \longrightarrow x^\prime - x = -\frac{y}{e^{2y}}$

$\left\{ \begin{array}{l} p(y) = -1 &\\ q(y) = \frac{-y}{e^{2y}} \end{array} \right.$

$\int p(y) dy = \int -dy = -y$

$x = \frac{1}{e^{\int p(y) dy}} (\int e^{\int p(y) dy} q(y) dy + c)$

$x = \frac{1}{e^{-y}} (\int e^{-y} \frac{-y}{e^{2y}} dy + c) \longrightarrow x = e^y (\int -e^{-3y} y \ dy + c)$

$\left\{ \begin{array}{l} u = y \longrightarrow du = dy &\\ dv = -e^{-3y} dy \longrightarrow v = \frac{e^{-3y}}{3} \end{array} \right.$

$\int -e^{-3y} y \ dy = \int u \ dv = uv - \int v \ du = y \frac{e^{-3y}}{3} - \int \frac{e^{-3y}}{3} dy$

$\int -e^{-3y} y \ dy = \frac{y}{3e^{3y}} - (\frac{-1}{3})) \frac{e^{-3y}}{3} = \frac{y}{3e^{3y}} + \frac{1}{9} e^{-3y}$

$x = e^y (\frac{y}{3} e^{-3y} + \frac{1}{9} e^{-3y} + c) \longrightarrow x = e^{-2y} (\frac{y}{3} + \frac{1}{9}) + c e^y$.

تمرین معادلهی برنولی

- $y^\prime - \frac{y}{x} = y^2$

$n = 2$

$y^\prime y^{-2} - \frac{1}{xy} = 1$

$u = \frac{1}{y^{2 - 1}} = \frac{1}{y} \longrightarrow y = \frac{1}{u} \longrightarrow y^\prime = (u^{-1})^\prime = -u^{-2} u^\prime$

$u^\prime (-u^{-2}) (u^2) - \frac{u}{x} = 1$

$-u^\prime - \frac{u}{x} = 1 \longrightarrow u^\prime + \frac{u}{x} = -1$

$\left\{ \begin{array}{l} p(x) = \frac{1}{x} &\\ q(x) = -1 \end{array} \right.$

$\int p(x) dx = \int \frac{dx}{x} = ln|x|$

$u = \frac{1}{e^{\int p(x) dx}} (\int e^{\int p(x) dx} q(x) dx + c)$

$u = \frac{1}{e^{ln|x|}} (\int e^{ln|x|} (-1) dx + c)$

$u = \frac{1}{x} (\int -\frac{dx}{x} + c) = \frac{1}{x} (-ln|x| + c)$

$\frac{1}{y} = \frac{-ln|x| + c}{x}$

$y = \frac{x}{-ln|x| + c}$.

- $y^\prime + xy = \frac{x}{y^3}$

$n = 3$

$u = \frac{1}{y^{3 - 1}} = \frac{1}{y^2} \longrightarrow y^{-2} = u \longrightarrow -2y^{-3}dy = du \longrightarrow dy = \frac{du}{-2}y^3$

$y^\prime y^{-3} + xy^{-2} = x$

$\frac{-u^\prime}{2} + xu = x \longrightarrow u^\prime - 2xu = -2x$

$\left\{ \begin{array}{l} p(x) = -2x &\\ q(x) = -2x \end{array} \right.$

$\int p(x) dx = \int -2x \ dx = -x^2$

$u = \frac{1}{e^{\int p(x) dx}} (\int e^{\int p(x) dx} q(x) dx + c)$

$u = \frac{1}{e^{-x^2}} (\int e^{-x^2} (-2x) dx + c)$

$\left\{ \begin{array}{l} v = -x^2 &\\ dv = -2x \ dx \end{array} \right.$

$\int -e^{-x^2} 2x \ dx = \int e^v dv = e^v = e^{-x^2}$

$u = \frac{1}{e^{-x^2}} (e^{-x^2} + c) = 1 + c e^{x^2}$

$\frac{1}{y^2} = 1 + c e^{x^2} \longrightarrow y^2 = \frac{1}{1 + c e^{x^2}}$

$y = \sqrt{\frac{1}{1 + c e^{x^2}}}$.

معادلات خطی مرتبهی دوم همگن (با ضرایب ثابت)

معادلاتی هستند به فرم زیر

$y^{\prime \prime} + a y^{\prime} + by = 0$

که در اینجا آ و ب عددهای ثابتی هستند. به این دسته از معادلات همگن نیز گفته میشود زیرا در سمت راست معادله صفر وجود دارد. برای حل کردن این نوع معادلات، ابتدا باید معادلهی مفسر (مشخصه) را به دست آوریم و حل کنیم. معادلهی مفسر، معادلهای درجه دوم است که به صورت زیر به دست میآید:

$r^2 + ar + b = 0$

این معادله را با روش دلتا حل میکنیم.

حالت اول

اگر دلتا بزرگتر از صفر باشد، معادلهی مفسر دو ریشهی مجزا آر پاییننویس ۱ و آر پاییننویس ۲ خواهد داشت. در این صورت جواب معادلهی دیفرانسیل به شکل زیر است:

$\Delta > 0 \longrightarrow y = c_1 e^{r_1 x} + c_2 e^{r_2 x}$.

مثال

معادلهی دیفرانسیل زیر را حل کنید.

$y^{\prime \prime} + y^{\prime} - 2y = 0$

$\left\{ \begin{array}{l} a = 1 &\\ b = -2 \end{array} \right.$

معادلهی مفسر را تشکیل میدهیم.

$r^2 + r - 2 = 0$,

$\Delta = 1^2 - 4 (1) (-2) = 9 > 0$,

$r_1 = \frac{-1 + \sqrt{9}}{2 (1)} = 1$,

$r_2 = \frac{-1 - \sqrt{9}}{2 (1)} = -2$,

$y = c_1 e^{x} + c_2 e^{-2x}$.

حالت دوم

اگر دلتا برابر با صفر باشد، در این حالت معادلهی مفسر یک ریشهی مضاعف دارد. فرض کنید که آر ریشهی آن باشد. جواب معادلهی دیفرانسیل به صورت زیر است:

$\Delta = 0 \longrightarrow y = (c_1 + c_2 x) e^{r x}$.

مثال

معادلهی دیفرانسیل زیر را حل کنید.

$y^{\prime \prime} + 4 y^{\prime} + 4y = 0$.

معادلهی مفسر را تشکیل میدهیم:

$r^2 + 4r + 4 = 0$

$\Delta = 4^2 - 4 (1) (4) = 0 \longrightarrow r = \frac{-4}{2 (1)} = -2$

$y = (c_1 + c_2 x) e^{-2x}$.

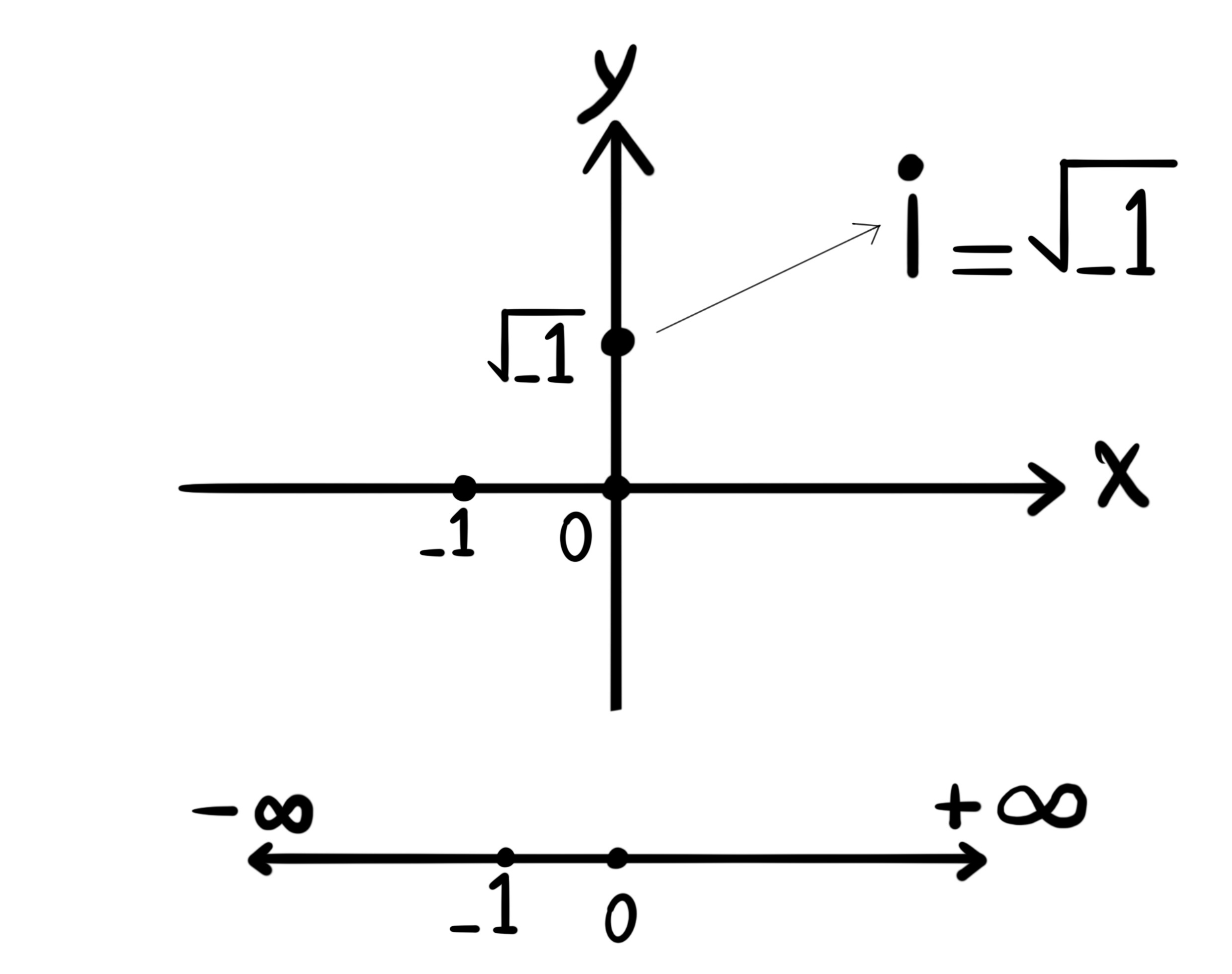

حالت سوم

$\Delta < 0$

اگر دلتا کوچکتر از صفر باشد، معادلهی مفسر ریشهی حقیقی ندارد. عدد آی عددی موهومی است.

$i^2 = -1 \longrightarrow i = \sqrt{-1}$

$z^2 = -1 \longrightarrow z^2 + 1 = 0$

$i \in \mathbb{C}$

در این حالت، معادلهی مفسر دو ریشهی مختلط به شکل زیر دارد.

$\left\{ \begin{array}{l} r_1 = \alpha + \beta i &\\ r_2 = \alpha - \beta i \end{array} \right.$

$r_1, r_2 \in \mathbb{C} = \{ x + y i | x \in \mathbb{R}, y \in \mathbb{R} \}$

در این صورت، جواب معادلهی دیفرانسیل به شکل زیر خواهد بود:

$y = e^{\alpha x} (c_1 cos(\beta x) + c_2 sin(\beta x))$

مثال

معادلهی مرتبه دوم با ضرایب ثابت (همگن) را حل کنید.

$y^{\prime \prime} + 4 y^{\prime} + 5y = 0$

معادلهی مشخصه را تشکیل میدهیم.

$r^2 + 4r + 5 = 0$,

$\Delta = 16 - 20 = -4$,

$r_1 = \frac{-4 + \sqrt{-4}}{2} = -2 + i$,

$r_2 = \frac{-4 - \sqrt{-4}}{2} = -2 - i$,

$\left\{ \begin{array}{l} \alpha = -2 &\\ \beta = 1 \end{array} \right.$,

$y = e^{-2x} (c_1 cos(x) + c_2 sin(x))$.

معادلات غیرکامل

پیشتر گفتیم که معادلاتی به شکل زیر به شرطی که مشتق جزیی تابع ام نسبت به متغیر وای برابر با مشتق جزیی تابع ان نسبت به متغیر ایکس باشد کامل هستند.

$\left\{ \begin{array}{l} M(x, y) dx + N(x, y) dy = 0 &\\ \frac{\partial M}{\partial y} = \frac{\partial N}{\partial x} \end{array} \right.$

اگر شرط بالا برقرار نباشد، معادله غیر کامل است.

$\frac{\partial M}{\partial y} \neq \frac{\partial N}{\partial x}$

برای حل کردن معادلات غیر کامل، باید عبارتی مانند تابع ایچ بر حسب متغیرهای ایکس و وای را پیدا کنیم، به طوری که با ضرب کردن دو طرف معادله در تابع ایچ معادله کامل شود.

$h(x, y)$

یعنی معادلهی زیر کامل باشد.

$h(x, y) M(x, y) dx + h(x, y) N(x, y) dy = 0$

به تابع ایچ که بر حسب متغیرهای ایکس و وای است عامل انتگرالساز گفته میشود. عامل انتگرالساز منحصر به فرد نمیباشد. و در حالت کلی پیدا کردن عامل انتگرالساز کار بسیار سختی است. اما در اینجا در دو حالت خیلی خاص عامل انتگرالساز را معرفی میکنیم.

حالت اول

اگر معادلهی زیر غیر کامل باشد، یعنی مشتق جزیی تابع ام نسبت به متغیر وای نابرابر با مشتق جزیی تابع ان نسبت به متغیر ایکس باشد،

$\left\{ \begin{array}{l} M(x, y) dx + N(x, y) dy = 0 &\\ \frac{\partial M}{\partial y} \neq \frac{\partial N}{\partial x} \end{array} \right.$

و همچنین عبارت پی عبارتی فقط بر حسب متغیر ایکس باشد،

$p(x) = \frac{1}{N} (\frac{\partial M}{\partial y} - \frac{\partial N}{\partial x})$

آنگاه عامل انتگرالساز برابر است با:

$e^{\int p(x) dx}$.

حالت دوم

اگر عبارت پی عبارتی فقط بر حسب متغیر وای باشد،

$p(y) = \frac{-1}{M} (\frac{\partial M}{\partial y} - \frac{\partial N}{\partial x})$

آنگاه عامل انتگرالساز برابر است با:

$e^{\int p(y) dy}$.

مثال

معادلهی غیرکامل زیر را حل کنید.

$dx + \frac{x - sin(y)}{y} dy = 0$.

$\left\{ \begin{array}{l} M(x, y) = 1 &\\ N(x, y) = \frac{x - sin(y)}{y} \end{array} \right.$

$\left\{ \begin{array}{l} \frac{\partial M}{\partial y} = 0 &\\ \frac{\partial N}{\partial x} = \frac{1}{y} \end{array} \right.$

$\left\{ \begin{array}{l} 0 \neq \frac{1}{y} &\\ \frac{\partial M}{\partial y} \neq \frac{\partial N}{\partial x} \end{array} \right.$

پس معادله غیرکامل است. حالا مقدار عبارت پی را محاسبه میکنیم تا عامل انتگرالساز را پیدا کنیم.

$p(y) = \frac{-1}{1} (0 - \frac{1}{y}) = \frac{1}{y}$

عبارت پی به طور تمام بر حسب متغیر وای به دست آمد. سپس عامل انتگرالساز را به شکل زیر به دست میآوریم:

$e^{\int p(y) dy} = e^{\int \frac{1}{y} dy} = e^{ln|y|} = y$

دو طرف معادله را در عامل انتگرالساز ضرب میکنیم تا معادله کامل شود.

$y \ dx + (x - sin(y)) dy = 0$

$\left\{ \begin{array}{l} M_1(x, y) = y &\\ N_1(x, y) = x - sin(y) \end{array} \right.$

دوباره شرط کامل بودن معادله را بررسی میکنیم.

$\left\{ \begin{array}{l} \frac{\partial M_1}{\partial y} = 1 &\\ \frac{\partial N_1}{\partial x} = 1 \end{array} \right.$

$\frac{\partial M_1}{\partial y} = \frac{\partial N_1}{\partial x}$

پس معادله کامل شد. در ادامه، معادلهی کامل را حل میکنیم تا به تابع مجهول اف برسیم.

$f(x, y) = \int M_1(x, y) dx + h(y) = \int y \ dx + h(y)$

$f(x, y) = xy + c + h(y)$

$\frac{\partial f(x, y)}{\partial y} = N_1(x, y) = \frac{\partial}{\partial y} (xy + c + h(y))$

مقدار مشتق جزیی تابع اف نسبت به متغیر ایگرگ را با مقدار عبارت تابع ان پاییننویس ۱ مقایسه میکنیم تا مقدار مشتق تابع ایچ بر حسب متغیر ایگرگ را بیابیم.

$N_1(x, y) = x + h^{\prime}(y)$,

$x + h^{\prime}(y) = x - sin(y) \longrightarrow h^{\prime}(y) = -sin(y)$,

$f(x, y) = xy + c + \int h^{\prime}(y) dy = xy + c + \int -sin(y) dy$,

$f(x, y) = xy + c + cos(y) + c_1$,

$f(x, y) = xy + cos(y) + c_2$.

تمرین

معادلهی غیرکامل را حل کنید.

$(x^2 + x - y^2) dx + x y \ dy = 0$.

$\left\{ \begin{array}{l} M(x, y) = x^2 + x - y^2 &\\ N(x, y) = xy \end{array} \right.$

$\left\{ \begin{array}{l} \frac{\partial M(x, y)}{\partial y} = -2y &\\ \frac{\partial N(x, y)}{\partial x} = y \end{array} \right.$

$\frac{\partial M}{\partial y} \neq \frac{\partial N}{\partial x}$

معادله غیرکامل است. برای پیدا کردن عامل انتگرالساز به شکل زیر عمل میکنیم.

$\frac{\partial M}{\partial y} - \frac{\partial N}{\partial x} = -2y - y = -3y$

$p(x) = \frac{1}{N} (\frac{\partial M}{\partial y} - \frac{\partial N}{\partial x}) = \frac{1}{xy} (-3y) = \frac{-3}{x}$

به دلیل اینکه پی عبارتی فقط بر حسب متغیر ایکس است، عامل انتگرالساز برابر است با:

$e^{\int p(x) dx} = e^{-3 \int \frac{dx}{x}} = e^{-3 ln|x|} = e^{ln|x^{-3}|} = x^{-3}$

با ضرب کردن عامل انتگرالساز در دو طرف معادله، آن را کامل میکنیم.

$x^{-3} (x^2 + x - y^2) dx + x^{-3} (xy) dy = 0$

$(x^{-1} + x^{-2} - y^2 x^{-3}) dx + (x^{-2} y) dy = 0$

$\left\{ \begin{array}{l} M_1(x, y) = x^{-1} + x^{-2} - y^2 x^{-3} &\\ N_1(x, y) = x^{-2} y \end{array} \right.$

$\frac{\partial M_1}{\partial y} = -2y x^{-3}$

$\frac{\partial N_1}{\partial x} = -2x^{-3} y$

معادلهی دیفرانسیل پس از ضرب کردن عامل انتگرالساز کامل شد.

$\frac{\partial M_1}{\partial y} = \frac{\partial N_1}{\partial x}$

$f(x, y) = \int M_1(x, y) dx + h(y) = \int x^{-1} + x^{-2} - y^2 x^{-3} \ dx + h(y)$

$f(x, y) = ln|x| - \frac{1}{x} + y^2 \frac{x^{-2}}{2} + c + h(y)$

$N_1(x, y) = \frac{\partial f(x, y)}{\partial y} = \frac{\partial}{\partial y} (ln|x| - \frac{1}{x} + y^2 \frac{x^{-2}}{2} + c + h(y))$

مشتق جزیی تابع اف نسبت به متغیر ایگرگ را با تابع ان پاییننویس ۱ مقایسه میکنیم تا مقدار مشتق تابع ایچ را پیدا کنیم.

$N_1(x, y) = yx^{-2} + h^{\prime}(y)$,

$h^{\prime}(y) = 0 \longrightarrow h(y) = \int h^{\prime}(y) dy = \int 0 dy = c_1$,

$f(x, y) = ln|x| - \frac{1}{x} + y^2 \frac{x^{-2}}{2} + c + c_1$,

$f(x, y) = ln|x| - \frac{1}{x} + y^2 \frac{x^{-2}}{2} + c_2$.

تبدیل لاپلاس

در ریاضیات تبدیلهایی داریم که یک تابع را به تابع دیگری تبدیل میکند. برای مثال، مشتقگیری یک تبدیل است که تابع اف بر حسب متغیر ایکس را به تابع اف پریم بر حسب متغیر ایکس تبدیل میکند.

$D: f(x) \to f^{\prime}(x)$,

$D f(x) = f^{\prime}(x)$.

تبدیل لاپلاس یک تبدیل انتگرالی است که تابع اف بر حسب متغیر تی (که به طور معمول زمان فرض میشود) را به تابع اف بر حسب متغیر اس (که به طور معمول فرکانس فرض میشود) تبدیل میکند. تبدیل لاپلاس کاربردهایی در فیزیک دارد، اما در اینجا (درس معادلات دیفرانسیل) ما فقط به این نکته توجه میکنیم که تبدیل لاپلاس میتواند ابزاری برای حل بعضی از معادلات دیفرانسیل باشد. تبدیل لاپلاس تابع اف بر حسب متغیر تی به صورت زیر تعریف میشود:

$L\{ f(t) \} = \int_0^\infty e^{-st} f(t) dt = F(s)$.

مثال

تبدیل لاپلاس تابع اف بر حسب متغیر تی با ضابطهی داده شده در زیر، را به دست آورید.

$f(t) = 1$

$L\{ f(t) \} = \int_0^{\infty} e^{-st} dt = -\frac{1}{s} e^{-st} |_0^\infty = 0 - (-\frac{1}{s}) = \frac{1}{s}$.

به شرطی که متغیر اس بزرگتر از صفر باشد.

$s > 0$

به دلیل اینکه علامت منفی متغیر اس انتگرال را بینهایت میکند. یعنی انتگرال واگرا میشود. divergent

مثال

تبدیل لاپلاس تابع اف بر حسب متغیر تی را به دست آورید.

$f(t) = e^{at}$

$L\{ e^{at} \} = \int_0^\infty e^{-st} e^{at} dt = \int_0^\infty e^{(a - s) t} dt$

$L\{ e^{at} \} = \frac{e^{(a - s) t}}{a - s} |_0^\infty = \frac{e^{(a - s) \infty}}{a - s} - \frac{e^0}{a - s}$

$\left\{ \begin{array}{l} a > s \longrightarrow \infty &\\ a < s \longrightarrow -\frac{1}{a - s} = \frac{1}{s - a} \end{array} \right.$

یادآوری ریاضی عمومی

روش تغییر متغیر:

$\int e^{at} dt$

$u = at \longrightarrow du = a \ dt$

$\frac{1}{a} \int e^u du = \int e^{at} dt = \frac{1}{a} e^u + c = \frac{1}{a} e^{at} + c$

جدول تبدیل لاپلاس

$f(t) \to L \{ f(t) \} = F(s)$:

$f(t) = 1 \to L\{ 1 \} = F(s) = \frac{1}{s}, \ D_F: s > 0$,

$f(t) = e^{at} \to L\{ e^{at} \} = F(s) = \frac{1}{s - a}, \ D_F: s > 0$,

$f(t) = t \to L\{ t \} = F(s) = \frac{1}{s^2}, \ D_F: s > 0$,

$f(t) = t^n \ (n \in \mathbb{N}) \to L\{ t^n \} = F(s) = \frac{n!}{s^{n + 1}}, \ D_F: s > 0$,

$f(t) = cos(at) \to L\{ cos(at) \} = F(s) = \frac{s}{s^2 + a^2}, \ D_F: s > 0$,

$f(t) = sin(at) \to L\{ sin(at) \} = F(s) = \frac{a}{s^2 + a^2}, \ D_F: s > 0$.

تبدیل معکوس لاپلاس

$F(s) \leftrightarrow f(t)$

فرض کنید تابع اف بزرگ بر حسب متغیر اس را داشته باشیم و بخواهیم تابع اف کوچک بر حسب متغیر تی را پیدا کنیم. به این کار، تبدیل معکوس لاپلاس گفته میشود. برای مثال، فرض کنیم داشته باشیم:

$F(s) = \frac{1}{s - 8}$

آنگاه داریم:

$L^{-1}\{ \frac{1}{s - 8} \} = e^{8t} = f(t)$

مثال

تبدیل معکوس لاپلاس تابع زیر را به دست آورید.

$F(s) = \frac{5s - 1}{s^2 - 1}$

$\frac{5s - 1}{s^2 - 1} = \frac{5s - 1}{(s + 1) (s - 1)} = \frac{A}{s - 1} + \frac{B}{s + 1} = \frac{A (s + 1) + B (s - 1)}{(s - 1) (s + 1)}$

$\frac{As + Bs + A - B}{(s - 1) (s + 1)} = \frac{(A + B) s + (A - B)}{(s - 1) (s + 1)}$

$\left\{ \begin{array}{l} A + B = 5 &\\ A - B = -1 \end{array} \right.$

$\left\{ \begin{array}{l} 2A = 4 \longrightarrow A = 2 &\\ B = 3 \end{array} \right.$

از خاصیت خطی تبدیل لاپلاس معکوس استفاده میکنیم.

$L^{-1} \{ \frac{5s - 1}{s^2 - 1} \} = L^{-1} \{ \frac{2}{s - 1} + \frac{3}{s + 1} \} = 2 e^t + 3 e^{-t}$.

تمرین

$L^{-1} \{ \frac{3s - 2}{s^3} \}$

$L^{-1} \{ \frac{3s - 2}{s^3} \} = L^{-1} \{ \frac{A}{s^3} + \frac{B}{s^2} + \frac{C}{s} \} = L^{-1} \{ \frac{A + Bs + Cs^2}{s^3} \}$

$3s - 2 = A + Bs + C s^2$

$\left\{ \begin{array}{l} A = -2 &\\ B = 3 &\\ C = 0 \end{array} \right.$

$L^{-1} \{ \frac{3s - 2}{s^3} \} = L^{-1} \{ \frac{-2}{s^3} + \frac{3}{s^2} + \frac{0}{s} \} = L^{-1} \{ \frac{-2}{s^3} \} + L^{-1} \{ \frac{3}{s^2} \} = -t^2 + 3t$

$t^n \leftrightarrow \frac{n!}{s^{n + 1}}$

تبدیل لاپلاس مشتق

اگر تبدیل لاپلاس تابع اف بر حسب متغیر تی و تبدیل لاپلاس تابع اف پریم بر حسب متغیر تی موجود باشد،

$L\{ f(t) \}, \ L\{ f^{\prime}(t) \}$

آن گاه:

$L \{ f^{\prime}(t) \} = s L \{ f(t) \} - f(0)$

$L \{ f^{\prime \prime}(t) \} = s L \{ f^\prime (t) \} - f^\prime (0)$

$L \{ f^{\prime \prime} (t) \} = s (s L \{ f(t) \} - f(0)) - f^\prime (0)$

$L \{ f^{\prime \prime} (t) \} = s^2 L \{ f(t) \} - s \ f(0) - f^\prime (0)$

مثال

به کمک تبدیل لاپلاس، معادلهی دیفرانسیل زیر را با شرایط اولیهی داده شده حل کنید.

$y^\prime + y = e^{2t}$,

$f(0) = y(0) = 0$.

برای حل کردن معادله از دو طرف معادله تبدیل لاپلاس میگیریم.

$L \{ y^\prime + y \} = L \{ e^{2t} \}$

$L \{ y^\prime \} + L \{ y \} = \frac{1}{s - 2}$

$s \ L \{ y \} - y(0) + L \{ y \} = \frac{1}{s - 2}$

$L \{ y \} (s + 1) = \frac{1}{s - 2}$

$L \{ y \} = \frac{1}{(s + 1) (s - 2)} \longrightarrow y = L^{-1} \{ \frac{1}{(s + 1) (s - 2)} \}$

$\frac{1}{(s + 1) (s - 2)} = \frac{A}{s + 1} + \frac{B}{s - 2} = \frac{A (s - 2) + B (s + 1)}{(s + 1) (s - 2)} = \frac{(A + B) s - 2A + B}{(s + 1) (s - 2)}$

$\left\{ \begin{array}{l} A + B = 0 &\\ -2A + B = 1 \end{array} \right.$

$3A = -1 \longrightarrow A = \frac{-1}{3} \longrightarrow B = \frac{1}{3}$

$y = L^{-1} \{ \frac{\frac{-1}{3}}{s + 1} + \frac{\frac{1}{3}}{s - 2} \} = \frac{-1}{3} L^{-1} \{ \frac{1}{s + 1} \} + \frac{1}{3} L^{-1} \{ \frac{1}{s - 2} \}$

$y = \frac{-1}{3} e^{-t} + \frac{1}{3} e^{2t}$.

یادآوری

$L \{ y^\prime \} = s L \{ y \} - y(0)$.

$L \{ y^{\prime \prime} \} = s L \{ y^{\prime} \} - y^\prime (0) = s (s L \{ y \} - y(0)) - y^\prime (0)$,

$L \{ y^{\prime \prime} \} = s^2 L \{ y \} - s \ y(0) - y^{\prime} (0)$.

مثال

معادلهی دیفرانسیل زیر با شرایط اولیهی داده شده را با استفاده از تبدیل لاپلاس حل کنید.

$y^{\prime \prime} - 4 y^\prime - 5 y = 0$,

$\left\{ \begin{array}{l} y(0) = 1 &\\ y^\prime (0) = 0 \end{array} \right.$.

$L \{ y^{\prime \prime} - 4 y^\prime - 5y \} = L \{ 0 \}$

$L \{ y^{\prime \prime} \} - 4 L \{ y^\prime \} - 5 L \{ y \} = 0$

$s^2 L \{ y \} - s (1) - 4 (s L \{ y \} - 1) - 5 L \{ y \} = 0$

$s^2 L \{ y \} - s - 4s L \{ y \} + 4 - 5 L \{ y \} = 0$

$L \{ y \} (s^2 - 4s - 5) - s + 4 = 0$

$L \{ y \} (s^2 - 4s - 5) = s - 4$

$L \{ y \} = \frac{s - 4}{s^2 - 4s - 5} \longrightarrow y = L^{-1} \{ \frac{s - 4}{s^2 - 4s - 5} \}$

$\frac{s - 4}{s^2 - 4s - 5} = \frac{s - 4}{(s + 1) (s - 5)} = \frac{A}{s + 1} + \frac{B}{s - 5}$

$\frac{A (s - 5) + B (s + 1)}{(s + 1) (s - 5)} = \frac{(A + B) s - 5A + B}{(s + 1) (s - 5)}$

$\left\{ \begin{array}{l} A + B = 1 &\\ -5A + B = -4 \end{array} \right.$

$\left\{ \begin{array}{l} A + B = 1 &\\ 5A - B = 4 \end{array} \right.$

$\left\{ \begin{array}{l} 6A = 5 \longrightarrow A = \frac{5}{6} &\\ B = 1 - \frac{5}{6} = \frac{1}{6} \end{array} \right.$

$y = L^{-1} \{ \frac{\frac{5}{6}}{s + 1} + \frac{\frac{1}{6}}{s - 5} \} = \frac{5}{6} L^{-1} \{ \frac{1}{s + 1} \} + \frac{1}{6} L^{-1} \{ \frac{1}{s - 5} \}$

$y = \frac{5}{6} e^{-t} + \frac{1}{6} e^{5t}$

اگر که بخواهیم سوال را با روش قبل حل کنیم:

$y^{\prime \prime} - 4 y^\prime - 5y = 0$

معادلهی مفسر را مینویسیم:

$r^2 - 4r - 5 = 0$

$\Delta = \frac{4 \pm \sqrt{16 + 20}}{2}$

$\Delta = \frac{4 \pm 6}{2} = 2 \pm 3$

$\left\{ \begin{array}{l} r_1 = 5 &\\ r_2 = -1 \end{array} \right.$

$(r + 1) (r - 5) = 0$

$y = c_1 e^{r_1 x} + c_2 e^{r_2 x} \longrightarrow y = c_1 e^{-t} + c_2 e^{5t}$

شرایط اولیهی معادله را بررسی میکنیم تا ضریبهای تابع نمایی را پیدا کنیم.

$\left\{ \begin{array}{l} y(0) = 1 &\\ y^\prime (0) = 0 \end{array} \right.$

$y(0) = 1 \longrightarrow c_1 e^{-(0)} + c_2 e^{5 (0)} = 1 \longrightarrow c_1 + c_2 = 1$

$y^\prime (0) = 0 \longrightarrow y^\prime = -c_1 e^{-x} + 5 c_2 e^{5x} = 0$

$y^\prime (0) = -c_1 e^0 + 5c_2 e^0 = 0 \longrightarrow -c_1 + 5c_2 = 0$

$\left\{ \begin{array}{l} c_1 + c_2 = 1 &\\ -c_1 + 5c_2 = 0 \end{array} \right.$

$6c_2 = 1 \longrightarrow c_2 = \frac{1}{6}$

$c_1 + \frac{1}{6} = 1 \longrightarrow c_1 = 1 - \frac{1}{6} = \frac{5}{6}$

$y = \frac{5}{6} e^{-t} + \frac{1}{6} e^{5t}$.

تمرین

معادلهی دیفرانسیل زیر را به کمک تبدیل لاپلاس حل کنید.

$y^{\prime \prime} - 2 y^\prime - 8y = 0$,

$\left\{ \begin{array}{l} y(0) = 1 &\\ y^\prime (0) = 0 \end{array} \right.$

تبدیل لاپلاس مشتقهای مرتبهی اول و مرتبهی دوم را محاسبه میکنیم.

$L \{ y^\prime \} = s L \{ y \} - y(0)$

$L \{ y^{\prime \prime} \} = s L \{ y^\prime \} - y^\prime (0) = s (s L \{ y \} - y(0)) - y^\prime (0)$

$L \{ y^{\prime \prime} \} = s^2 L \{ y \} - s \ y(0) - y^\prime (0)$

از خاصیت خطی بودن تبدیل لاپلاس استفاده میکنیم تا معادلهی دیفرانسیل را تبدیل کنیم.

$s^2 L \{ y \} - s \ y(0) - y^\prime (0) - 2s \ L \{ y \} + 2y(0) - 8 L \{ y \} = 0$.

از تبدیل لاپلاس متغیر وای فاکتور میگیریم.

$L \{ y \} (s^2 - 2s - 8) - s y(0) - y^\prime (0) + 2 y(0) = 0$

شرایط اولیه را در معادلهی تبدیل شده جایگذاری میکنیم.

$L \{ y \} (s^2 - 2s - 8) - s + 2 = 0 \longrightarrow L \{ y \} (s^2 - 2s - 8) = s - 2$

$L \{ y \} = \frac{s - 2}{s^2 - 2s - 8} \longrightarrow L \{ y \} = \frac{s - 2}{(s - 4) (s + 2)}$

$\sqrt{\Delta} = \sqrt{(-2)^2 - 4 (1) (-8)} = \sqrt{4 + 32} = \sqrt{36} = 6$

$s_{1, 2} = \frac{2 \pm 6}{2} = 1 \pm 3$

$\left\{ \begin{array}{l} s_1 = 4 &\\ s_2 = -2 \end{array} \right.$

$y = L^{-1} \{ \frac{s - 2}{(s - 4) (s + 2)} \} = L^{-1} \{ \frac{A}{s - 4} + \frac{B}{s + 2} \}$

$y = L^{-1} \{ \frac{A (s + 2)}{(s - 4) (s + 2)} + \frac{B (s - 4)}{(s - 4) (s + 2)} \}$

$y = L^{-1} \{ \frac{As + 2A + Bs - 4B}{(s - 4) (s + 2)} \} = L^{-1} \{ \frac{s - 2}{(s - 4) (s + 2)} \}$

$\left\{ \begin{array}{l} A + B = 1 &\\ 2A - 4B = -2 \end{array} \right.$

$\left\{ \begin{array}{l} A + B = 1 &\\ -A + 2B = 1 \end{array} \right.$

$3B = 2 \longrightarrow B = \frac{2}{3} \longrightarrow A = \frac{1}{3}$

$y = L^{-1} \{ \frac{\frac{1}{3}}{s - 4} + \frac{\frac{2}{3}}{s + 2} \} = \frac{1}{3} L^{-1} \{ \frac{1}{s - 4} \} + \frac{2}{3} L^{-1} \{ \frac{1}{s + 2} \}$

$y = \frac{1}{3} e^{4t} + \frac{2}{3} e^{-2t}$.

نکته

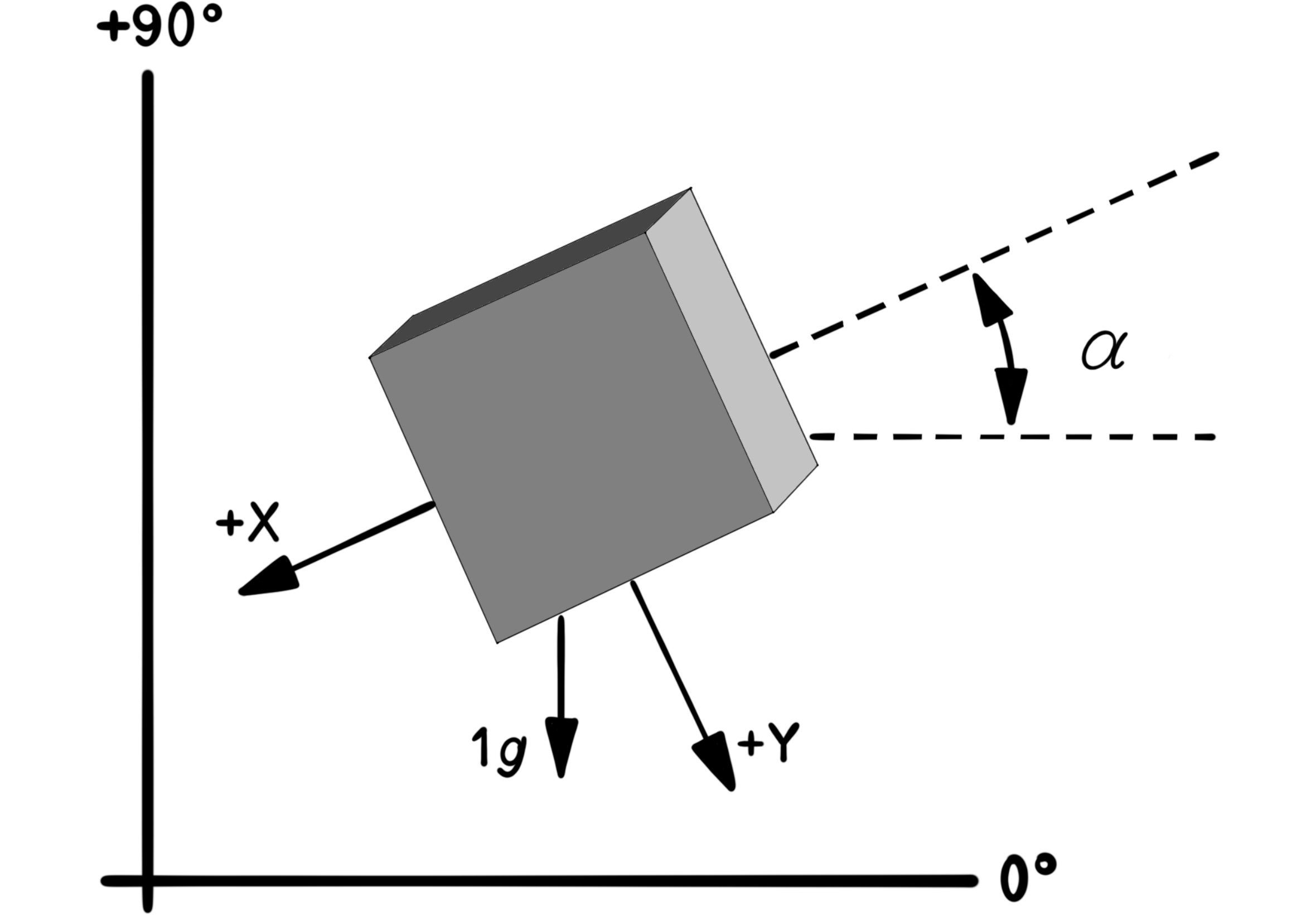

برای استفاده کردن از شتاب در معادلهی دیفرانسیل به سرعت اولیه نیاز داریم. اما برای استفاده کردن از سرعت در معادلهی دیفرانسیل به مکان اولیه نیاز داریم.

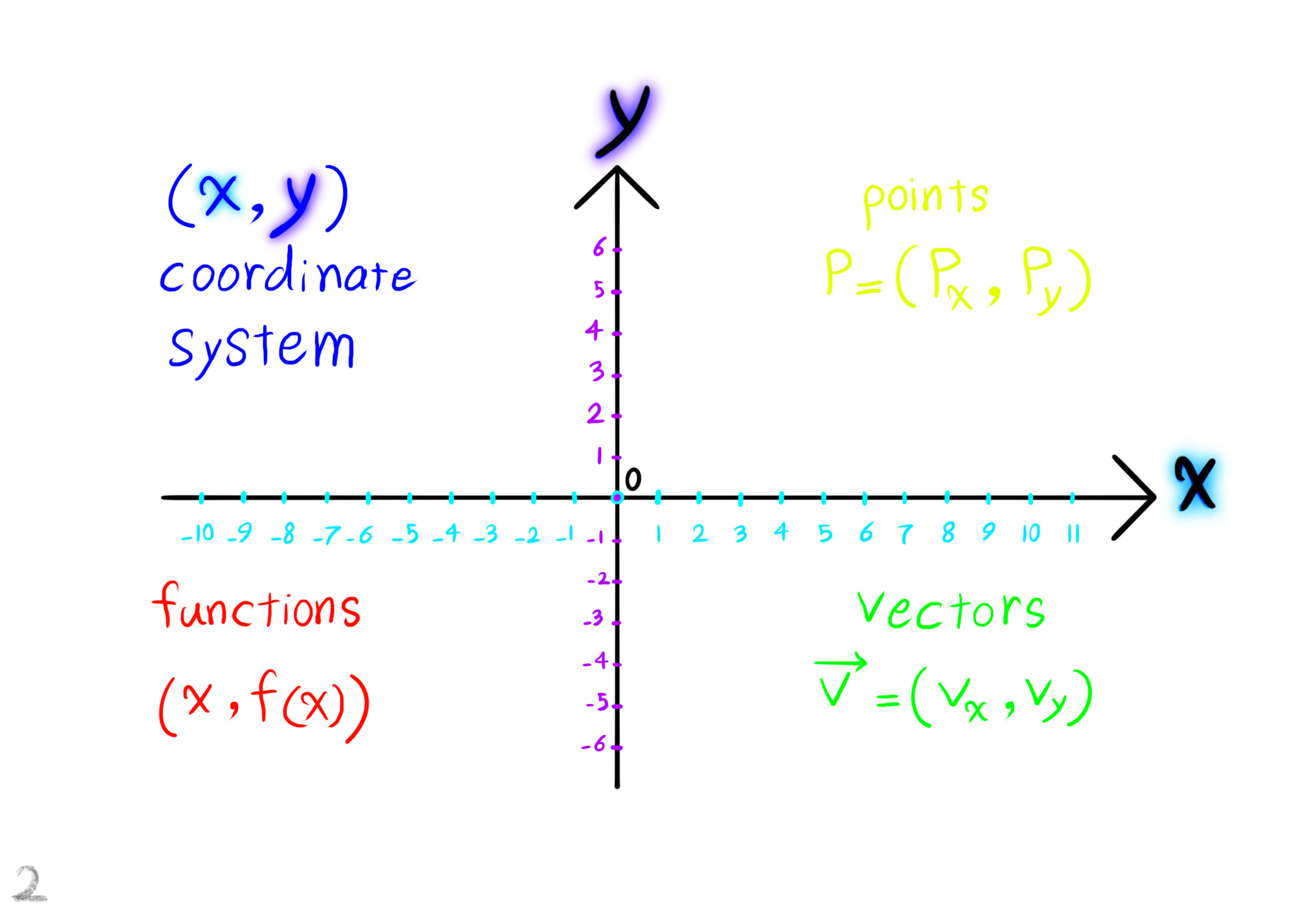

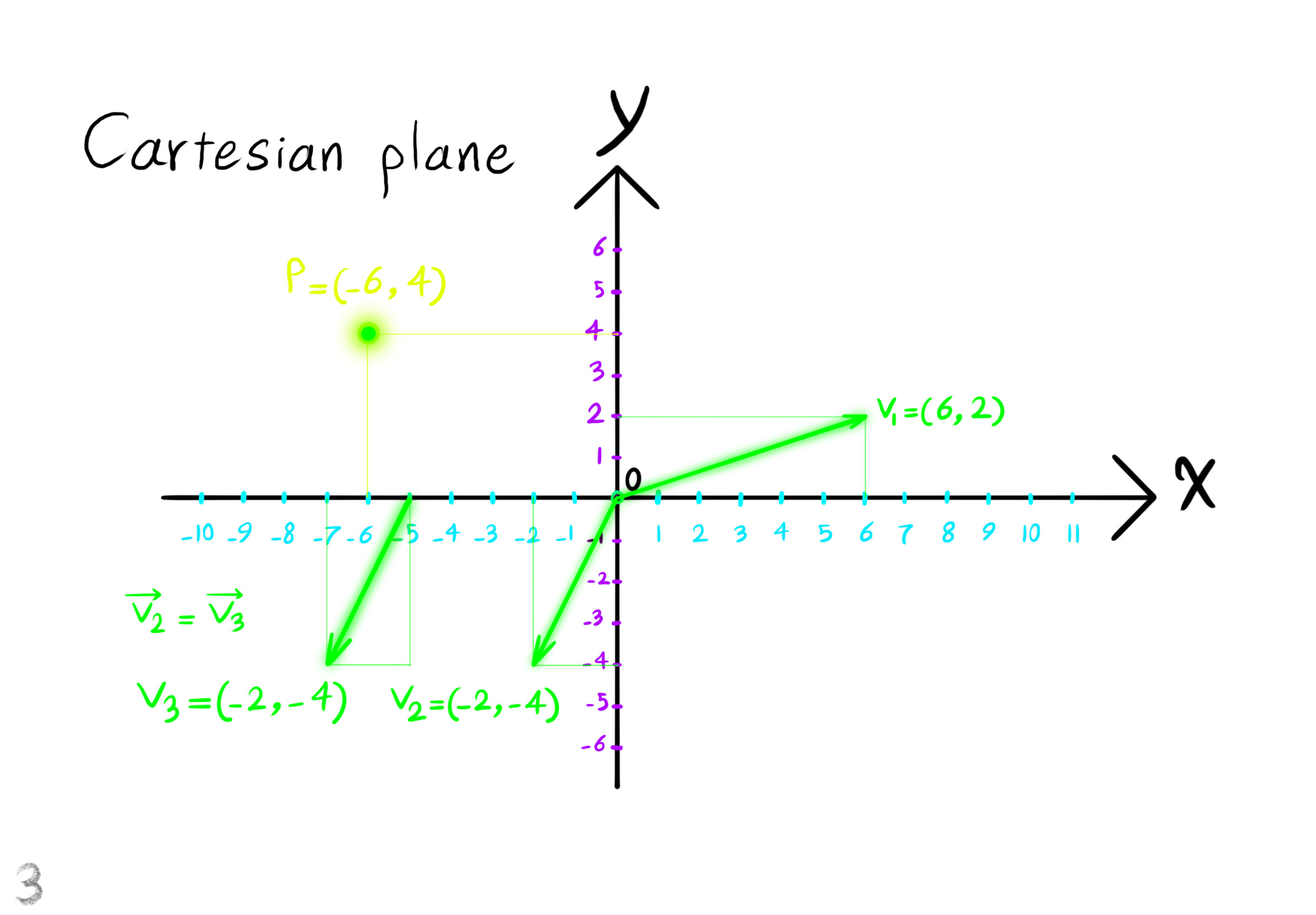

دستگاه معادلات دیفرانسیل

$\left\{ \begin{array}{l} y_1^{\prime} = 2 y_1 + 3 y_2 &\\ y_2^{\prime} = 4 y_1 - 2 y_2 \end{array} \right.$,

$y = f(x)$.

$y_1^{\prime \prime} = 2y_1^\prime + 3y_2^\prime \longrightarrow y_1^{\prime \prime} = 2y_1^\prime + 3(4y_1 - 2y_2) \longrightarrow y_1^{\prime \prime} = 2y_1^\prime + 12y_1 - 2(3y_2)$

$y_1^{\prime \prime} = 2y_1^\prime + 12y_1 - 2(y_1^\prime - 2y_1) \longrightarrow y_1^{\prime \prime} = 16y_1 \longrightarrow y_1^{\prime \prime} - 16y_1 = 0$

به یک معادلهی دیفرانسیل خطی مرتبهی دوم با ضرایب ثابت رسیدیم. حالا معادلهی مفسر را تشکیل میدهیم.

$r^2 - 16 = 0 \longrightarrow r^2 = 16 \longrightarrow r = \pm 4$

یادآوری: معادلهی خطی مرتبه دوم با ضرایب ثابت.

$\left\{ \begin{array}{l} y^{\prime \prime} + ay^\prime + by = 0 &\\ r^2 + ar + b = 0 \end{array} \right.$

در نتیجه برای حل معادله داریم:

$y_1 = c_1 e^{r_1 x} + c_2 e^{r_2 x} = c_1 e^{4x} + c_2 e^{-4x}$

$y_1^\prime = 4c_1 e^{4x} - 4c_2 e^{-4x} = 2(c_1 e^{4x} + c_2 e^{-4x}) + 3y_2$

$y_2 = \frac{1}{3} (4c_1 e^{4x} - 4c_2 e^{-4x} - 2(c_1 e^{4x} + c_2 e^{-4x}))$

$y_2 = \frac{1}{3} ((4c_1 - 2c_1) e^{4x} + (-2 c_2 - 4 c_2) e^{-4x})$

$y_2 = \frac{2}{3} c_1 e^{4x} - 2c_2e^{-4x}$

تمرین

دستگاه معادله ی دیفرانسیل زیر را حل کنید.

$\left\{ \begin{array}{l} y_1^\prime = y_1 + y_2 &\\ y_2^\prime = 4y_1 - 2y_2 \end{array} \right.$

$y = f(x)$

$y_1^{\prime \prime} = y_1^\prime + y_2^\prime \longrightarrow y_1^{\prime \prime} = y_1^\prime + (4y_1 - 2y_2)$

$y_1^{\prime \prime} = y_1^\prime + 4y_1 - 2(y_1^\prime - y_1) \longrightarrow y_1^{\prime \prime} = -y_1^\prime + 6y_1$

$y_1^{\prime \prime} + y_1^\prime - 6y_1 = 0$.

به یک معادلهی دیفرانسیل خطی مرتبهی دوم با ضرایب ثابت رسیدیم. پس باید معادلهی مفسر را در ادامه بنویسیم.

$\left\{ \begin{array}{l} r^2 + ar + b = 0 &\\ y^{\prime \prime} + ay^\prime + by = 0 \end{array} \right.$

$\left\{ \begin{array}{l} a = 1 &\\ b = -6 \end{array} \right.$

$r^2 + r - 6 = 0$

$r_{1, 2} = \frac{-1 \pm \sqrt{(1)^2 - 4 (1) (-6)}}{2} = \frac{-1 \pm \sqrt{1 - (-24)}}{2} = \frac{-1 \pm \sqrt{25}}{2}$

$\left\{ \begin{array}{l} r_1 = -3 &\\ r_2 = 2 \end{array} \right.$

$\Delta = 25 > 0$

$y_1 = c_1 e^{r_1 x} + c_2 e^{r_2 x} \longrightarrow y_1 = c_1 e^{2 x} + c_2 e^{-3 x}$

$y_1^\prime = 2 c_1 e^{2 x} - 3 c_2 e^{-3 x}$

$y_2 = y_1^\prime - y_1 = 2 c_1 e^{2 x} - 3 c_2 e^{-3 x} - y_1$

$y_2 = 2 c_1 e^{2 x} - 3 c_2 e^{-3 x} - c_1 e^{2 x} - c_2 e^{-3 x}$.

تمرین

دستگاه معادله ی دیفرانسیل زیر را حل کنید.

$\left\{ \begin{array}{l} y_1^\prime = 2y_1 - 5y_2 &\\ y_2^\prime = 5y_1 - 6y_2 \end{array} \right.$

$y = f(x)$

از مشتق تابع وای پاییننویس ۱، یک بار مشتق میگیریم تا به مشتق مرتبهی دوم آن دست پیدا کنیم.

$y_1^{\prime \prime} = 2y_1^\prime - 5y_2^\prime = 2y_1^\prime - 5(5y_1 - 6y_2) = 2y_1^\prime - 25y_1 + 30y_2$

از طرفی داریم:

$-5y_2 = y_1^\prime - 2y_1 \longrightarrow y_2 = \frac{-1}{5}y_1^\prime + \frac{2}{5} y_1$

$y_1^{\prime \prime} = 2y_1^{\prime} - 25y_1 + 30(\frac{-1}{5}y_1^\prime + \frac{2}{5}y_1) = 2y_1^\prime - 25y_1 - 6y_1^\prime + 12y_1$

$y_1 ^{\prime \prime} = -4y_1^\prime - 13y_1 \longrightarrow y_1^{\prime \prime} + 4y_1^\prime + 13y_1 = 0$

به یک معادلهی خطی مرتبه دوم با ضرایب ثابت رسیدیم. پس معادلهی مفسر را ایجاد میکنیم.

$\left\{ \begin{array}{l} r^2 + ar + b = 0 &\\ y^{\prime \prime} + ay^\prime + by = 0 \end{array} \right.$

$\left\{ \begin{array}{l} a = 4 &\\ b = 13 \end{array} \right.$

$r^2 + 4r + 13 = 0$

$\sqrt{\Delta} = \sqrt{b_1^2 - 4a_1c_1} = \sqrt{(4)^2 - 4 (1) (13)} = \sqrt{16 - 52} = \sqrt{-36} = 6i$

$\Delta = -36 < 0$.

مقدار دلتا کوچکتر از صفر شد. پس جواب معادلهی دیفرانسیل به شکل زیر است:

$\left\{ \begin{array}{l} r_1 = \alpha + i \beta &\\ r_2 = \alpha - i \beta \end{array} \right.$

$\left\{ \begin{array}{l} r_1 = \frac{-4 + 6i}{2} &\\ r_2 = \frac{-4 - 6i}{2} \end{array} \right.$

$\left\{ \begin{array}{l} r_1 = -2 + 3i &\\ r_2 = -2 - 3i \end{array} \right.$

$\left\{ \begin{array}{l} \alpha = -2 &\\ \beta = 3 \end{array} \right.$

$y = e^{\alpha x} (c_1 \ cos(\beta x) + c_2 \ sin(\beta x))$

$y_1 = e^{-2x} (c_1 \ cos(3x) + c_2 \ sin(3x))$

$y_1^\prime = -2e^{-2x}(c_1cos(3x) + c_2sin(3x)) + e^{-2x}(-3c_1sin(3x) + 3c_2cos(3x))$

با جایگذاری مقدارهای تابع ایگرگ پاییننویس ۱ و مشتق آن در دستگاه معادلات دیفرانسیل به مقدار تابع ایگرگ پاییننویس ۲ میرسیم.

$y_1^\prime = 2y_1 - 5y_2 \longrightarrow y_2 = \frac{-1}{5} y_1^\prime + \frac{2}{5}y_1$,

$y_2 = \frac{-1}{5}(-2e^{-2x}(c_1cos(3x) + c_2sin(3x)) + e^{-2x}(-3c_1sin(3x) + 3c_2cos(3x))) + \frac{2}{5} e^{-2x}(c_1cos(3x) + c_2sin(3x))$.

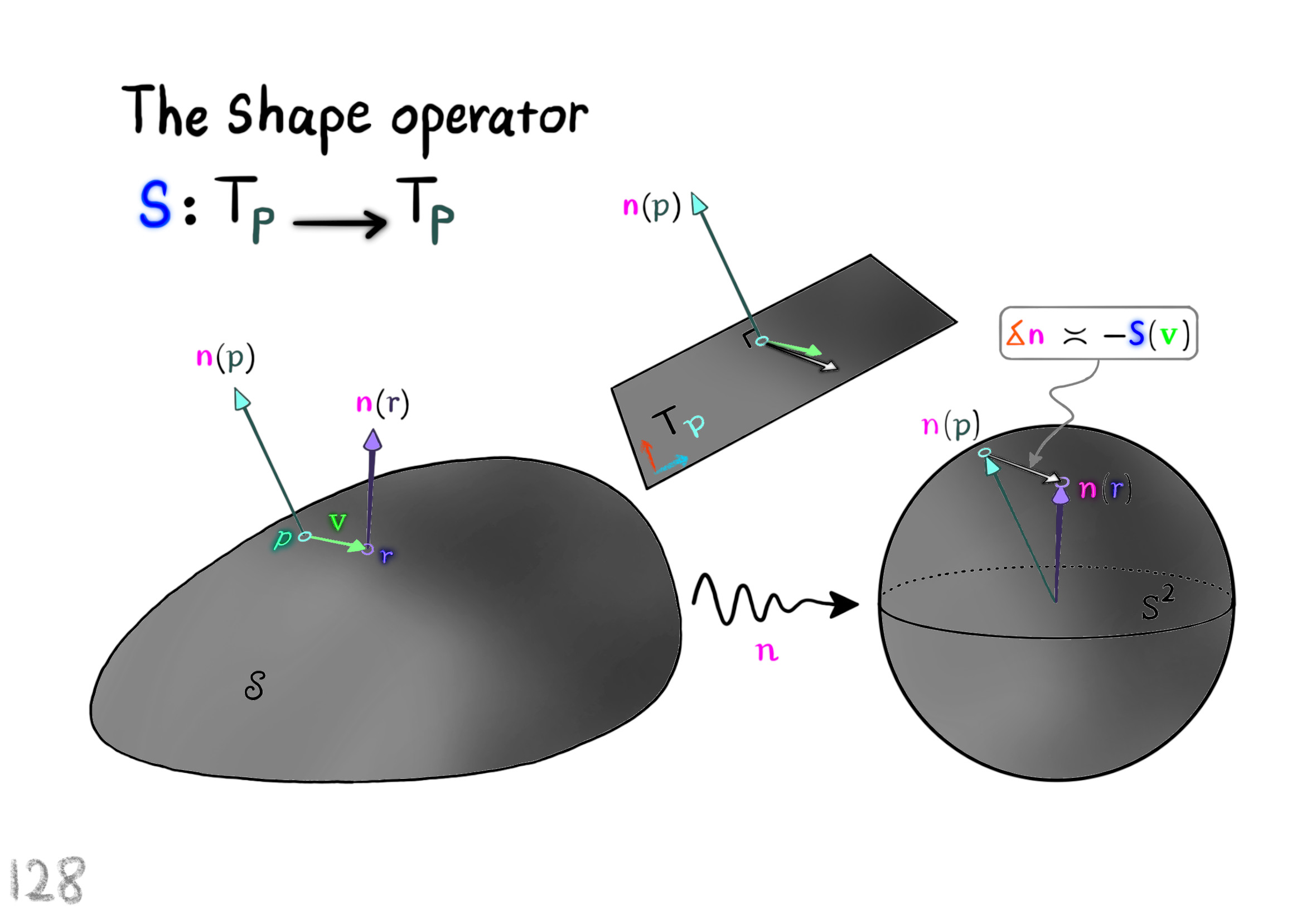

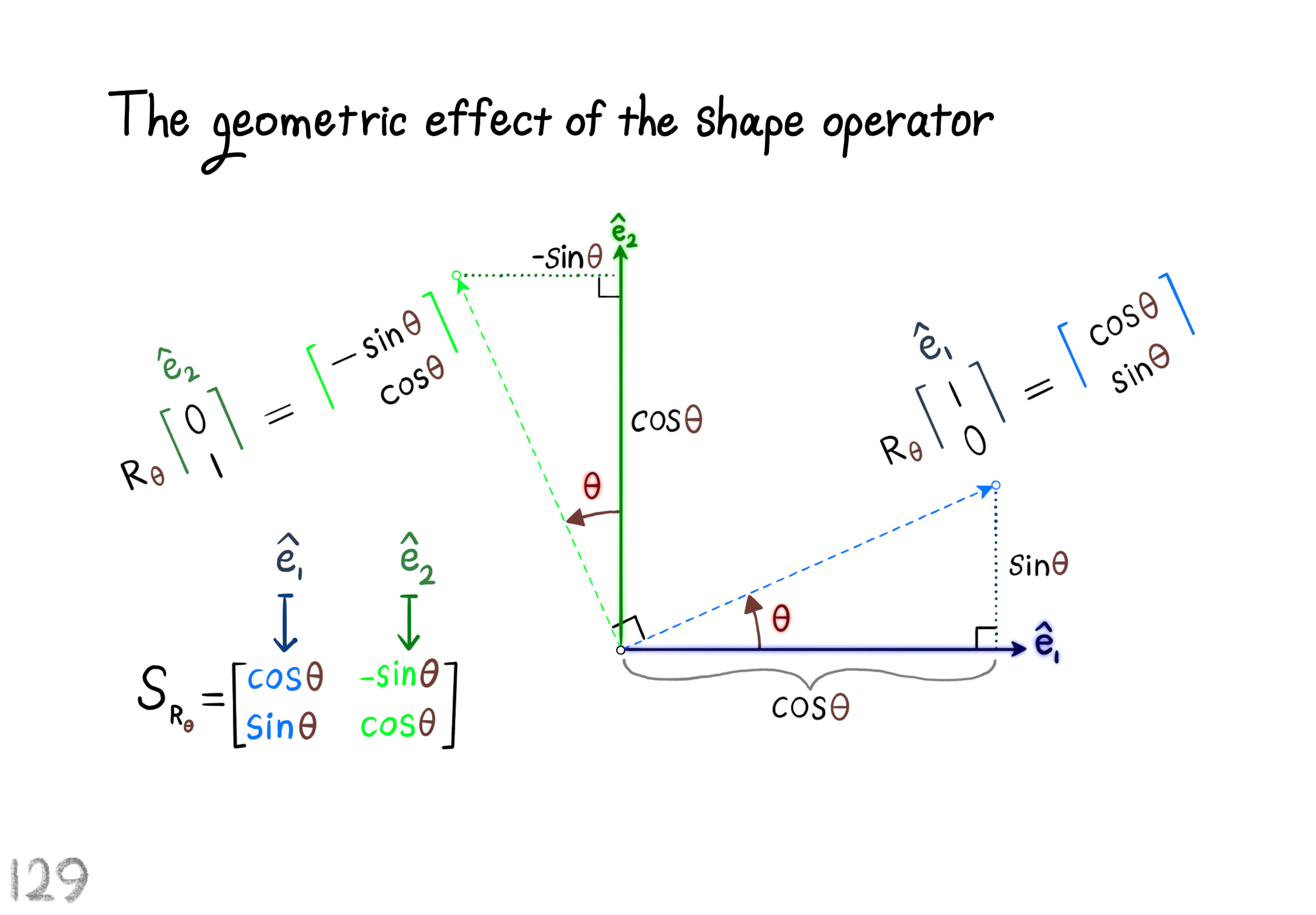

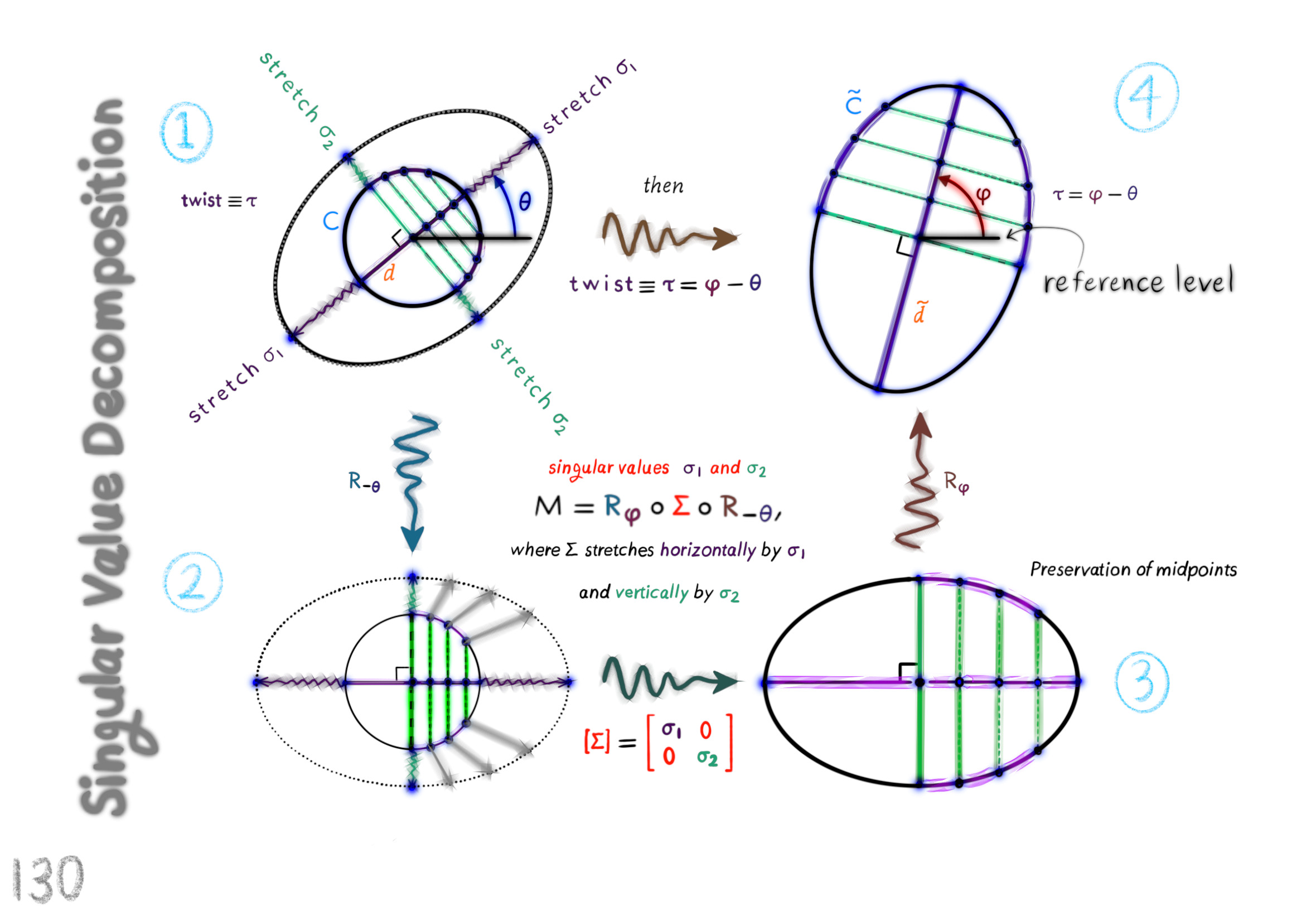

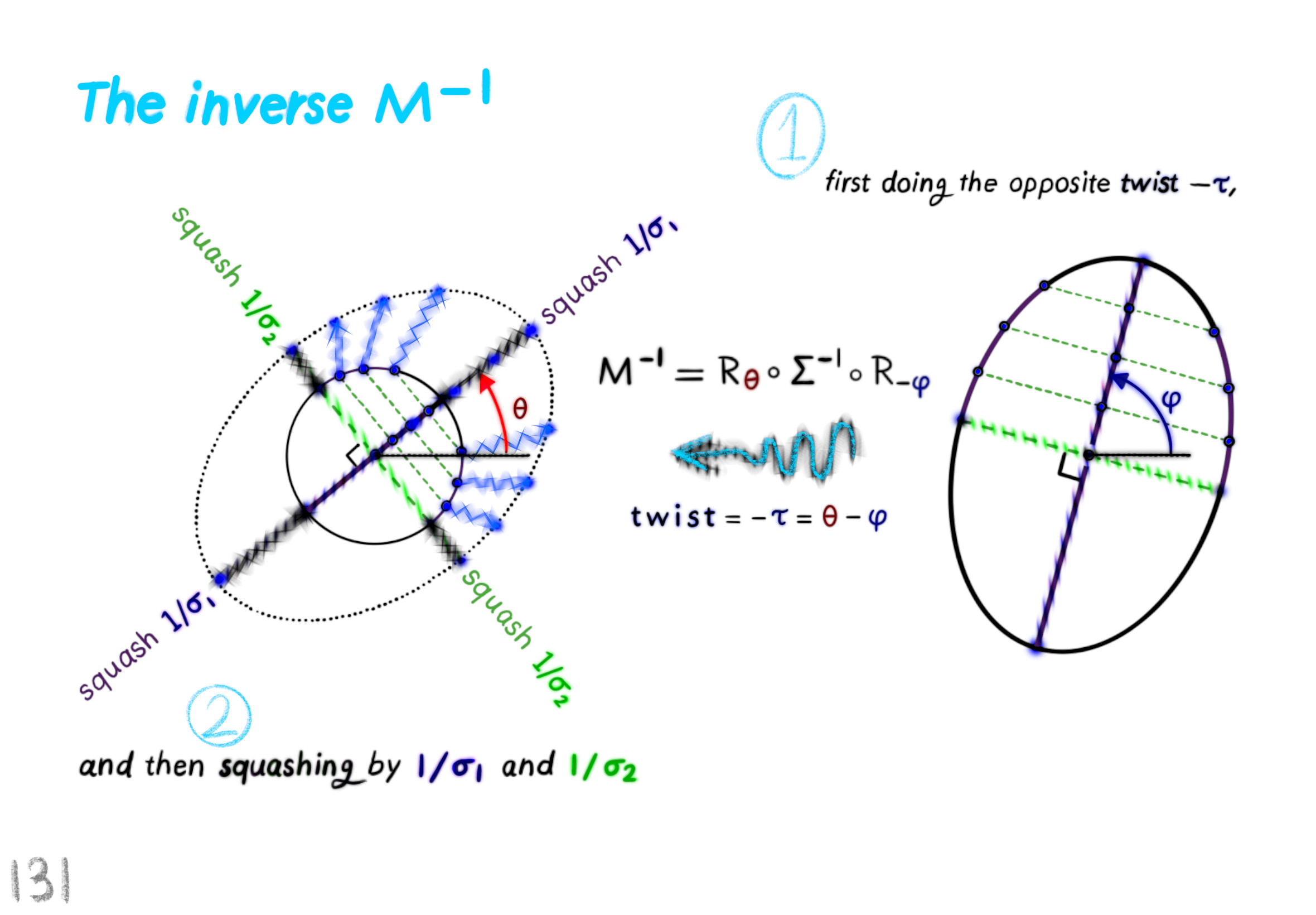

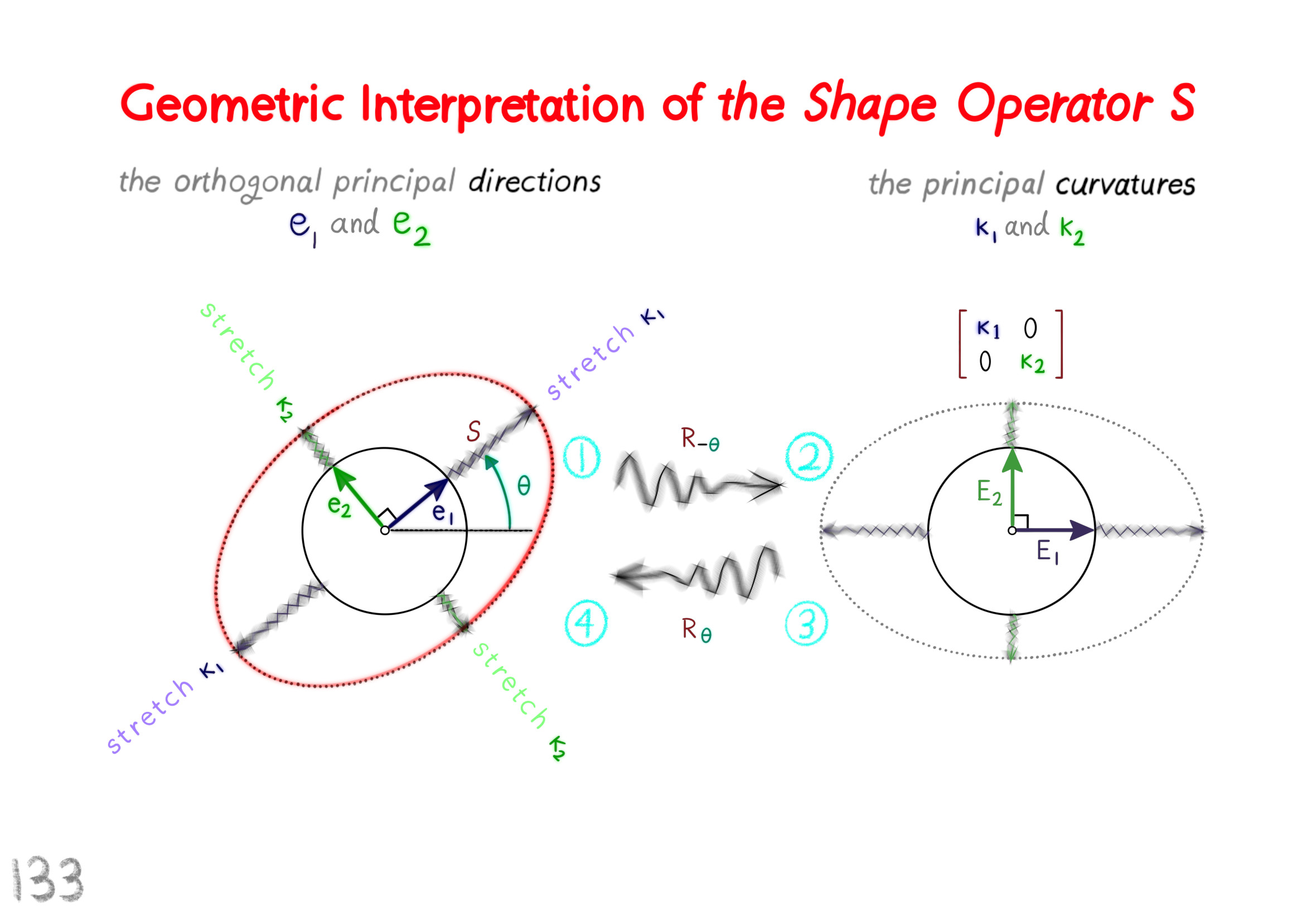

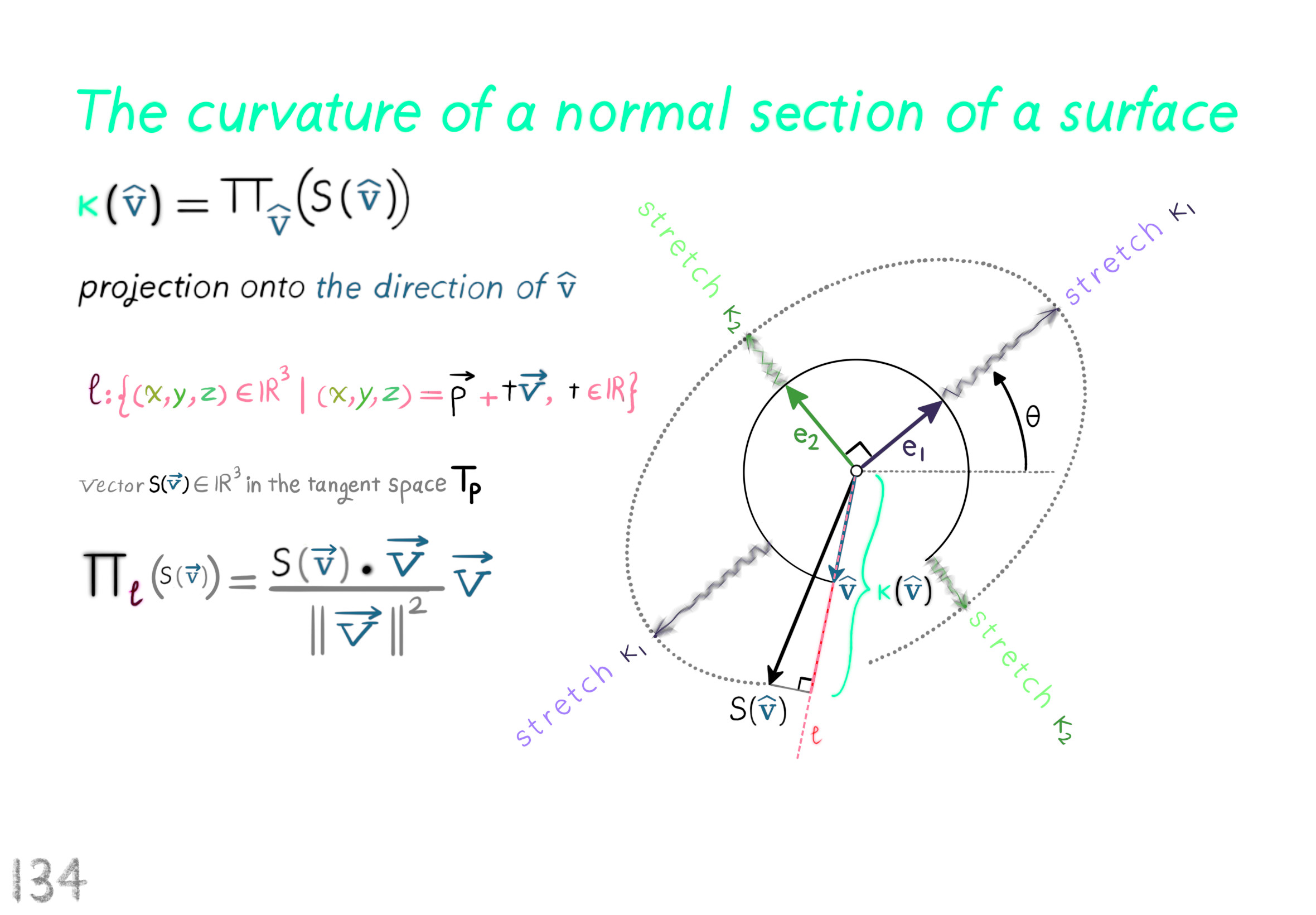

The Shape Operator

Square Roots of Definite Matrices

ریشهی دوم ماتریسهای معین

ماتریس هرمیتی یا خودآبن ماتریسی است مربعی که ترانهادهی مزدوج مختلط آن با خودش برابر باشد:

$A = \overline{A^T}$

$a_{ij} = \overline{a_{ji}}$

$a_{i, j} = a_{j, i}^*$

$A = A^\dagger$

اول از همه، به یاد بیاورید که یک ماتریس هرمیتی قابل تبدیل شدن به یک ماتریس قطری با مقدارهای ویژهی حقیقی است. پس، بگذارید ماتریس آ یک ماتریس مربعی ان در ان باشد به طوری که شرط زیر برقرار باشد:

$A \in \mathbb{R}^{n \times n}$

$A^* = A$

و بگذارید ان مقدار ویژهاش (به همراه تکرارها) با عبارت لاندا پاییننویس ۱، لاندا پاییننویس ۲، تا لاندا پاییننویس ان باشد.

${\lambda}_1, {\lambda}_2, ..., {\lambda}_n$

ماتریس دی را به شکل زیر تعریف کنید:

$D = diag[\lambda_1, \lambda_2, ..., \lambda_n]$

پس یک ماتریس یکانی با ابعاد ان در ان وجود دارد که با حرف یو نشان داده میشود به طوری که:

$U \in \mathbb{R}^{n \times n}$

$U^* U = I$

$A = U D U^*$

یک ماتریس هرمیتی، مثبت معین (مثبت شبهمعین) نامیده میشود اگر برای متغیر غیر صفر ایکس در فضای ان بعدی مختلط عبارت زیر برقرار باشد:

$x^* A x > 0 \\ (x^* A x \geq 0)$

$x \in \mathbb{C}^n$

تعریفهای مشابهی برای ماتریسهای منفی معین و منفی شبهمعین صادق است. در این چهار مورد ما به ترتیب نابرابریهای زیر را مینویسیم:

$\left\{ \begin{array}{l} A > 0 &\\ A \geq 0 &\\ A < 0 &\\ A \leq 0 \end{array} \right.$

در مورد «مثبت» دو مشخصهی دیگر صادق است و در نتیجهی مقدماتی زیر وجود دارد.

قضیه ۱

سه عبارت زیر با یکدیگر معادل هستند:

$A > 0 \\ (A \geq 0)$

$\lambda_j > 0 \\ (\lambda_j \geq 0)$

به ازای همهی مقدارهای ویژهی ماتریس آ که با عبارت لاندا پاییننویس جی بیان میشوند.

- $A_0 > 0 \\ (A_0 \geq 0) \longrightarrow A_0^2 = A$

یک ماتریس به نام آ پاییننویس صفر وجود دارد به طوری که مجذور آن با ماتریس آ برابر است.

ماتریس آ پاییننویس صفر در قسمت سوم قضیهی بالا به طور طبیعی به صورت زیر نوشته میشود:

$A_0 = A^{\frac{1}{2}}$

همچنین توجه کنید که وقتی ماتریس آ حقیقی است، آنگاه ماتریس ریشهی دوم آ نیز حقیقی است.

روشن است که ماتریس آ بزرگتر مساوی با صفر این نتیجه را میدهد که داریم ماتریس دی بزرگتر مساوی با صفر است. همچنین، ریشهی دوم ماتریس دی برابر با مقدار زیر است:

$A \geq 0 \longrightarrow D \geq 0$

$D^{1/2} = diag[\lambda_1^{1/2}, \lambda_2^{1/2}, ..., \lambda_n^{1/2}]$

و با توجه به رابطهی ریشهی دوم ماتریس آ و ماتریس دی داریم:

$A^{1/2} = U D^{1 / 2} U^*$

فرض کنید که مقدارهای ویژه مثبت باشند و مقدارهای ویژه با پاییننوشت بزرگتر از متغیر آر برابر با صفر باشند.

$\lambda_1, \lambda_2, ..., \lambda_r > 0$

$\lambda_{r + 1} = \lambda_{r + 2} = ... = \lambda_n = 0$

اگر ستونهای ماتریس یو با متغیرهای زیر نشان داده شوند:

$u_1, u_2, ..., u_n$

پس رابطههای ماتریس آ و ریشهی دوم ماتریس آ در بالا به صورت زیر بازنویسی میشوند:

$A = \sum_{j = 1}^r \lambda_j u_j u_j^*$

$A^{1 / 2} = \sum_{j = 1}^r \lambda_j^{1 / 2} u_j u_j^*$

بلافاصله نتیجه میشود که:

$Ker(A^{1 / 2}) = Ker \ A = span\{ u_{r + 1}, ..., u_n \}$

$Im(A^{1 / 2}) = Im \ A = span\{ u_1, ..., u_r \}$

به طور ویژه، ریشهی دوم ماتریس آ و ماتریس آ از یک مرتبه هستند. این رابطهها به شکل زیر مستحکم میشوند.

قضیه ۲

اگر ماتریس آ بزرگتر مساوی با صفر باشد، پس هستهی ماتریس حاصلضرب ریشهی دوم ماتریس آ در ماتریس ایکس برابر است با هستهی ماتریس حاصلضرب ماتریس آ در ماتریس ایکس به ازای تمام ماتریسهای ان در ام به نام ماتریس ایکس، و تصویر ماتریس حاصلضرب ماتریس ایگرگ در ریشهی دوم ماتریس آ برابر است با تصویر ماتریس حاصلضرب ماتریس ایگرگ در ماتریس آ به ازای تمام ماتریسهای ام در ان به نام ماتریس ایگرگ.

$A \geq 0 \longrightarrow Ker (A^{1 / 2} X) = Ker(AX)$

$Im(Y A^{1 / 2}) = Im(Y A)$

$X \in \mathbb{R}^{n \times m}, \ y \in \mathbb{R}^{m \times n}$

اثبات

اگر رابطهی زیر به ازای بردار ایکس در فضای برداری مختلط امبعدی برقرار باشد

$x \in \mathbb{C}^m$

$A^{1 / 2} X x = 0$

پس داریم:

$A X x = A^{1 / 2} (A^{1 / 2} X x) = 0$

این ثابت میکند که هستهی حاصلضرب ریشهی دوم ماتریس آ در ماتریس ایکس زیرمجموعهی هستهی حاصلضرب ماتریس آ در ماتریس ایکس است.

$Ker(A^{1 / 2} X) \subseteq Ker(A X)$

برای اثبات عکس شمول، بگذارید که مقدمهی زیر درست باشد:

$A X x = 0$

بعد در نتیجه داریم:

$|| A^{ 1 / 2} X x ||^2 \ = \ <A^{1 / 2} X x, A^{1 / 2} X x > \ = \ < A X x, A X x > \ = \ 0$

و بنابراین حاصلضرب ریشهی دوم ماتریس آ در ماتریس ایکس در بردار ایکس برابر است با صفر.

$A X x = 0$

$A \geq 0 \longrightarrow Im(Y A^{1 / 2}) = Im(Y A)$

برای اثبات قسمت دوم این قضیه، ابتدا قرار دهید:.

$y Y A^{1 / 2} = 0$

$y \in \mathbb{C}^m$

بعد درنتیجه داریم:

$y Y A = (y Y A^{1 / 2}) A^{1 / 2} = 0$

این ثابت میکند که تصویر حاصلضرب ماتریس ایگرگ در ریشهی دوم آ زیرمجموعهی تصویر حاصلضرب ماتریس ایگرگ در آ است.

$Im(Y A^{1 / 2}) \subseteq Im(Y A)$

برای اثبات عکس شمول، قرار دهید:

$y Y A = 0$

که نتیجه میدهد:

$|| y Y A^{1 / 2}||^2 \ = \ < y Y A^{1 / 2}, y Y A^{1 / 2} > \ = \ < y Y A, y Y A > \ = \ 0$

و بنابراین حاصلضرب بردار ایگرگ در ماتریس ایگرگ در ریشهی دوم آ برابر است با صفر.

$y Y A^{1 / 2} = 0$.

$\square$

Linear Quadratic Regulator

سامانگر درجه دوم خطی

مسالهی «سامانگر درجه دوم خطی» در کنترل بهینه به احتمال بزرگترین انگیزه را برای تحقیق دربارهی معادلات ریکاتی ماتریسی در فرمهای دیفرانسیلی، تفاضلی، و جبری فراهم کرده است. در این بخش ابتدا مسایل سامانگر درجه دوم خطی پیوسته و گسسته را مطرح خواهیم کرد و سپس پاسخ این مسایل با استفاده از معادلات ریکاتی توسعه داده میشوند. در اینجا، توجه ما به مسایل ثابت در زمان معطوف است (یعنی ضرایب ثابت)، با این وجود که بخش قابل توجهی از این نظریه به طور آماده به مسایل خطی متغیر در زمان تعمیم داده میشوند (برای مثال، در بخش منابع بروکت ۱۳۴۸ را ببینید، همچنین کالمن، فالب و آربیب ۱۳۴۷، یا راسل ۱۳۵۷).

مشکل بهینهسازی

یک سامانهی خطی ثابت در زمان ابتدایی به فرم زیر را در نظر بگیرید:

$\dot{x}(t) = A x(t) + B u(t)$, $x(0) = x^0$

که در آن ماتریسهای آ و ب دارای ابعاد زیر هستند:

$A \in \mathbb{C}^{n \times n}$

$B \in \mathbb{C}^{n \times m}$

تابعهای برداری که با عبارتهای یو بر حسب متغیر تی و ایکس بر حسب متغیر تی بیان میشوند، به ترتیب با عنوان بردارهای کنترل (یا ورودی) و حالت شناخته میشوند. مشاهده کنید که تابع ایکس بر حسب متغیر تی به طور منحصربهفرد با یک تابع کنترل قابل انتگرالگیری به نام تابع یو بر حسب متغیر تی و یک بردار اولیهی ایکس بالانویس صفر به صورت زیر تعریف میشود.

$x(t) = e^{At} x^0 + \int_0^t e^{A(t - s)} B u(s) \ ds$

وقتی که بخواهیم روی این وابستگیها تاکید کنیم، مینویسیم:

$x(t) = x^u (t; x^0)$

فرض خواهد شد که تابعهای کنترل یو بر حسب متغیر تی برای زمانهای تی بزرگتر مساوی با صفر و کوچکتر از بینهایت تعریف شدهاند و دارای ویژگی زیر میباشند:

$0 \leq t < \infty$

$u \in L_m^2(0, T)$ for all $T > 0$

بگذارید که این دسته از تابعها با نماد زیر بیان شوند:

$\large{\textrm{u}}$

پس داریم

$\large{\textrm{u}} = \cap_{T > 0} L_m^2 (0, T)$

به طور ویژه، تابعهای درون دستهی زیر، کنترلهای قابل پذیرش هستند:

$L_m^2(0, \infty)$

فضایی که با حرف ال بزرگ نشان داده میشود، به طور معمول، فضای هیلبرت تابعهای برداری ایگرگ و زد در بازهی باز با نقطههای ایتدایی و انتهایی به ترتیب آ و ب است، با مقدارهایی در فضای برداری مختلط کا بعدی و ضرب داخلی زیر:

$L_k^2 (a, b)$

$y \in \mathbb{C}^k$, $z \in \mathbb{C}^k$

$(y, z) = \int_a^b z(t)^* y(t) dt$

برای تعریف کردن یک هزینه مرتبط با کنترلها و بردارهای اولیه، اول فرض کنید که یک ماتریس شبهمعین مثبت به نام آر کلاهدار با اندازهی ان به اضافهی ام داده شده است

$\hat{R} \in \mathbb{R}^{(n + m) \times (n + m)}$

$\hat{R} = \begin{bmatrix} Q & S \\ S^* & R \end{bmatrix} \geq 0$

$Q \in \mathbb{R}^{n \times n}$

$R \in \mathbb{R}^{m \times m}$

فرض میشود که ماتریس آر بزرگتر از صفر باشد و، به طور الزامی، ماتریس کیو بزرگتر مساوی با صفر است.

$R > 0 \longrightarrow Q \geq 0$

میگوییم که ماتریس آر کلاهدار غیرتبهگن است اگر که مرتبهی ماتریس آر کلاهدار برابر باشد با مجموع مرتبههای ماتریس کیو و ماتریس آر

$rank \ \hat{R} = rank \ Q + rank \ R$

حالا تابعک هزینهی درجه دوم را با رابطه ی زیر تعریف میکنیم

$J^u(x^0) = \int_0^\infty \begin{bmatrix} x(t)^* & u(t)^* \end{bmatrix} \hat{R} \begin{bmatrix} x(t) \\ u(t) \end{bmatrix} dt = \int_0^\infty || \begin{bmatrix} x(t) \\ u(t) \end{bmatrix} ||_{\hat{R}}^2 dt$

توجه کنید که تابع ایکس بر حسب متغیر تی با استفاده از تابع یو و بردار اولیهی ایکس بالانویس صفر در معادلهی بالاتر تعریف شده است. واضح است که

$0 \leq J^u(x^0) \leq \infty$

هزینهی بهینه در بردار اولیهی ایکس بالانویس صفر با این رابطه تعریف میشود

$\hat{J} (x^0) = \underset{u}{inf} \ J^u (x^0)$

و پس یک کنترل بهینه یک تابع کنترل یو است که برای آن این اینفیمم محاسبه میشود.

شاید طبیعیتر باشد که فرمول تابعک هزینه را بر حسب نرمهای کنترل و یک بردار خروجی به نام ایگرگ بنویسیم

$y(t) = C x(t) + D u(t)$

برای مثال

$||u||_{R_1}^2 + ||y||_{R_2}^2$

اما اگر این رابطه را بنویسیم

$\hat{R} = \begin{bmatrix} 0 & 0 \\ 0 & R_1 \end{bmatrix} + \begin{bmatrix} C^* \\ D^* \end{bmatrix} R_2 \begin{bmatrix} C & D \end{bmatrix}$

سپس مانند تعریف تابعک هزینه درجه دوم داریم

$||u||_{R_1}^2 + ||y||_{R_2}^2 = ||\begin{bmatrix} x \\ u \end{bmatrix}||_{\hat{R}}^2$

هدف مسالهی سامانگر مرتبه دوم خطی تعیین کردن شرایطی برای سامانه و ماتریس آر کلاهدار است که تضمین میکند به ازای هر بردار اولیهی ایکس بالانویس صفر یک کنترل بهینهی منحصربهفرد وجود دارد، و چنین کنترلی را مشخص کند.

$\left\{ \begin{array}{l} \dot{x}(t) = A x(t) + B u(t) \ , x(0) = x^0 &\\ \hat{R} \end{array} \right.$

خواهیم دید که در شرایط مناسب، یک کنترل بهینه میتواند با یک سازوکار پسخور مشخص شود. یعنی با فرض کردن پیوندی میان کنترل و حالت طبق رابطهی زیر

$u(t) = -F x(t)$

$F \in \mathbb{C}^{m \times n}$

جواب منحصربهفرد مسالهی مقدار اولیهی حاصل

$\dot{x}(t) = (A - BF) x(t)$, $x(0) = x^0$

سپس تابع یو بر حسب متغیر تی را به این شکل تعیین میکند

$u(t) = -F e^{(A - BF)t} x^0$, $t \geq 0$

نشان داده خواهد شد که در شرایط مناسبی، کنترل بهینه با یک ماتریس پسخور به شکل زیر تعیین میشود

$F = - B^* X$

که در اینجا ماتریس ایکس یک جواب خارجی معادلهی ریکاتی جبری مرتبط است.

تابعک هزینه برای مسالهی سامانگر درجه دوم خطی گسسته

حالا یک سامانهی «گسسته» در نظر بگیرید:

$x_{k + 1} = A x_k + B u_k$, $\ k = 0, 1, 2, ...$

$A \in \mathbb{C}^{n \times n}$

$B \in \mathbb{C}^{n \times m}$

$x_0$

$\{ u_k \}_{k = 0}^\infty$

$u_k \in \mathbb{C}^m$

که در آن بردار ایکس پاییننویس صفر داده شده است، و مجموعهی عبارت یو پاییننویس کا به ازای کا از صفر تا بینهایت، دنبالهای داده شده از بردارهای کنترل در فضای برداری امبعدی مختلط است. جواب این سامانه، یا رابطهی بازگشتی برابر است با

$x_k = A^k x_0 + \sum_{r = 0}^{k - 1} A^{k - r - 1} B u_r$, $\ k = 1, 2, 3, ...$

برای مقصود این بخش بهتر است که یک نماد مختصر برای دنبالهها داشته باشیم، چه با طول متناهی و چه نامتناهی. بنابراین، برای مثال میتوان نوشت

$\tilde{u} = \{ u_k \}_{k = 0}^\infty$

$\tilde{v} = \{ v_k \}_{k = 0}^K$

همچنین برای جواب دنبالهی موجود در رابطه ی بازگشتی بالاتر میتوانیم بنویسیم

$\tilde{x} = \{ x_k \}_{k = 0}^\infty = \tilde{x} (\tilde{u}, x_0) = \{ x_k(\tilde{u}, x_0) \}_{k = 0}^\infty$

و توجه کنید که

$\tilde{x}(\tilde{v} - \tilde{u}, x_0 - y_0) = \tilde{x} (\tilde{v}, x_0) - \tilde{x}(\tilde{u}, y_0)$

دنبالههای قابل قبول کنترلی به سادگی دنبالههای نامتناهی از بردارهایی در فضای برداری امبعدی مختلط هستند.

$\mathbb{C}^m$

پس، فضای کنترلها چنین تعریف میشود

$\large{\textrm{u}} = \{ \tilde{u} = \{ u_k \}_{k = 0}^\infty \ | \ u_k \in \mathbb{C}^m \}$

و مینویسیم

$\mathbb{C}^{m, K} = \{ \{ u_k \}_{k = 0}^K \ | \ u_k \in \mathbb{C}^m \}$

یک ضرب داخلی بر روی فضای برداری دنبالهها به شکل معمول تعریف میشود:

$(\tilde{u}, \tilde{v})_K = \sum_{j = 1}^K v_j^* u_j$

و سپس برای نرم دنباله داریم

$||\tilde{u}||_K = ((\tilde{u}, \tilde{u})_K)^{1 / 2}$

تابعک هزینه مرتبط با سامانهی گسسته بر حسب یک ماتریس شبهمعین مثبت به نام آر کلاهدار و با ابعاد ان به اضافهی ام تعریف میشود

$\hat{R} = \begin{bmatrix} Q & S \\ S^* & R \end{bmatrix} \geq 0$

$\hat{R} \in \mathbb{R}^{(n + m) \times (n + m)}$

$R > 0$

$R \in \mathbb{R}^{m \times m}$

سپس، به طور ضروری داریم

$\longrightarrow Q \geq 0$

$Q \in \mathbb{R}^{n \times n}$

هزینهی مرتبط با دنبالهی کنترلی یو تیلدا و بردار اولیهی ایکس پاییننویس صفر میشود

$\tilde{u} \in \large{\textrm{u}}$

$x_0 \in \mathbb{C}^m$

$J(\tilde{u}, x_0) = \sum_{k = 0}^\infty \begin{bmatrix} x_k^* & u_k^* \end{bmatrix} \begin{bmatrix} Q & S \\ S^* & R \end{bmatrix} \begin{bmatrix} x_k \\ u_k \end{bmatrix} = \sum_{k = 0}^\infty || \begin{bmatrix} x_k \\ u_k \end{bmatrix} ||_{\tilde{R}}^2$

هزینهی بهینه در بردار اولیهی ایکس پاییننویس صفر با این تعریف میشود

$\hat{J}(x_0) = \underset{\tilde{u} \in \large{\textrm{u}}}{inf} \ J(\tilde{u}, x_0)$

این تعریفها باید با تعریفهای زیر در مسالهی پیوسته مقایسه شوند:

$\left\{ \begin{array}{l} J^u(x^0) = \int_0^\infty \begin{bmatrix} x(t)^* & u(t)^* \end{bmatrix} \tilde{R} \begin{bmatrix} x(t) \\ u(t) \end{bmatrix} dt = \int_0^\infty ||\begin{bmatrix} x(t) \\ u(t) \end{bmatrix}||_{\tilde{R}}^2 dt &\\ \hat{J}(x^0) = \underset{u}{inf} \ J^u(x^0) \end{array} \right.$

تحقیق دربارهی خاصیتهای عبارت جی و جی کلاهدار به ترتیب مرتبط با هزینهی دنبالهی کنترلی و هزینهی بهینه در زمینهی مسالهی گسسته به این صورت انجام میشود:

لم ۱

بگذارید دنبالهای (از دنبالهها) با عبارت مجموعهی یو تیلدا پاییننویس کا داده شود و دنبالهی دیگری با عبارت مجموعهی ایکس پاییننویس کا و صفر داده شود به طوری که وقتی کا به سمت بینهایت میل کند حد عبارت ایکس پاییننویس کا و صفر به عبارت ایکس پاییننویس صفر میل کند.

$\{ \tilde{u}_k \} \subseteq \large{\textrm{u}}$

$\{ x_{k, 0} \} \subseteq \mathbb{C}^n$

$\left\{ \begin{array}{l} x_{k, 0} \to x_0 &\\ k \to \infty \end{array} \right.$

سپس یک زیردنباله به نام مجموعهی وی تیلدا پاییننویس کا و یک دنباله یو تیلدا وجود دارد به طوری که

$\{ \tilde{v}_k \} \subseteq \{ \tilde{u}_k \}$

$\tilde{u} \in \large{\textrm{u}}$

$(\tilde{w}, \tilde{v}_k - \tilde{u}_k)_K \to 0$

$(\tilde{w}, \tilde{x}(\tilde{v}_k, x_{k, 0}) - \tilde{x}(\tilde{u}, x_0))_K \to 0$

وقتی که کا به سمت بینهایت میل کند، و به ازای عبارت کای بزرگ بزرگتر از صفر و همهی عبارتهای دابلیو تیلدا

$k \to \infty$

$K > 0$

$\tilde{w} \in \large{\textrm{u}}$.

لم ۲

دنبالهی زیر را تعریف کنید

$\{ x_{r, 0} \}_{r = 0}^\infty \subseteq \mathbb{C}^n$

به طوری که وقتی متغیر آر به بینهایت میل میکند

$r \to \infty \longrightarrow x_{r, 0} \to x_0$

و یک دنباله تعریف کنید

$\{ \tilde{u}_r \} \subseteq \large{\textrm{u}}$

که برای آن حد زیر وجود دارد

$\underset{r \to \infty}{lim} \ J(\tilde{u}_r, x_{r, 0})$

سپس یک دنباله به نام وی تیلدا وجود دارد به طوری که

$\tilde{v} \in \large{\textrm{u}}$

$J(\tilde{v}, x_0) \leq \underset{r \to \infty}{lim} \ J(\tilde{u}_r, x_{r, 0})$

اثبات

هزینه در گام کای بزرگ را به این شکل تعریف کنید

$J_K(\tilde{u}, x_0) = \sum_{k = 0}^K || \begin{bmatrix} x_k \\ u_k \end{bmatrix} ||_{\tilde{R}}^2$

و یک زیردنباله به نام مجموعهی وی تیلدا از مجموعهی یو تیلدا تعریف کنید که خاصیتهای لم ۱ را داشته باشد.

$\{ \tilde{v} \} \subseteq \{ \tilde{u} \}$

$\tilde{u} \in \large{\textrm{u}}$

سپس، با استفاده از رابطهی زیر

$\tilde{x}(\tilde{v} - \tilde{u}, x_0 - y_0) = \tilde{x}(\tilde{v}, x_0) - \tilde{x}(\tilde{u}, y_0)$

میتوانیم نتیجه بگیریم که

$J_K(\tilde{v}_k - \tilde{u}_k, x_{k, 0} - x_0) = \sum_{r = 0}^K \begin{bmatrix} x_r(\tilde{v}_k, x_{k, 0})^* - x_r(\tilde{u}, x_0)^* & v_{k, r}^* - u_r^* \end{bmatrix} \tilde{R} \begin{bmatrix} x_r(\tilde{v}_k, x_{k, 0}) - x_r(\tilde{u}, x_0) \\ v_{k, r} - u_r \end{bmatrix}$

تعریف کنید

$\begin{bmatrix} y_r^* & z_r^* \end{bmatrix} = \begin{bmatrix} x_r(\tilde{u}, x_0)^* & u_r^* \end{bmatrix} \tilde{R}$

و سپس

$E_k^K (\tilde{y}, \tilde{z}) = \sum_{r = 0}^K \begin{bmatrix} y_r^* & z_r^* \end{bmatrix} \begin{bmatrix} x_r(\tilde{v}_k, x_{k, 0}) - x_r(\tilde{u}, x_0) \\ v_{k, r} - u_r \end{bmatrix} = \overline{(\tilde{z}, \tilde{v}_k - \tilde{u})}_K + \overline{(\tilde{y}, \tilde{x}(\tilde{v}_k, x_{k, 0}) - \tilde{x}(\tilde{u}, x_0))}_K$

و از لم ۱ نتیجه میشود که وقتی متغیر کا به سمت بینهایت میل کند

$k \to \infty \longrightarrow E_k^K(\tilde{y}, \tilde{z}) \to 0$

با کمی محاسبه کردن با رابطهی زیر میتوان نشان داد که

$J_K(\tilde{v}_k - \tilde{u}_k, x_{k, 0} - x_0) = \sum_{r = 0}^K \begin{bmatrix} x_r(\tilde{v}_k, x_{k, 0})^* - x_r(\tilde{u}, x_0)^* & v_{k, r}^* - u_r^* \end{bmatrix} \tilde{R} \begin{bmatrix} x_r(\tilde{v}_k, x_{k, 0}) - x_r(\tilde{u}, x_0) \\ v_{k, r} - u_r \end{bmatrix}$

$0 \leq J_K(\tilde{v}_k - \tilde{u}, x_{k, 0} - x_0) = J_K(\tilde{v}_k, x_k^0) - J_K(\tilde{u}, x_0) - 2Re \ E_k^K(\tilde{y}, \tilde{z})$

و بنابراین، با گرفتن حد وقتی که متغیر کا کوچک به سمت بینهایت میل میکند و متغیر کا بزرگ به سمت بینهایت میل میکند، به این ترتیب، این رابطه را به دست میآوریم:

$k \to \infty$

$K \to \infty$

$J(\tilde{v}, x_0) \leq \underset{r \to \infty}{lim} \ J(\tilde{u}_r, x_{r, 0})$

$\square$

شبهپیوسته بودن پایینی تابعک هزینهی بهینه جی کلاهدار حالا به سادگی برقرار میشود.

قضیه ۳

برای هر بردار اولیهی ایکس پاییننویس صفر یک دنبالهی یو تیلدا وجود دارد که در آن هزینهی بهینه به دست میآید:

$x_0 \in \mathbb{C}^n$

$\tilde{u} \in \large{\textrm{u}}$

$\hat{J}(x_0) = J(\tilde{u}, x_0)$

همچنین، برای هر دنباله به صورت

$\{ x_{k, 0} \} \subseteq \mathbb{C}^n$

با حد ایکس پاییننویس صفر وقتی که ماغیر کا به سمت بینهایت میل میکند

$k \to \infty \longrightarrow x_{k, 0} \to x_0$

گزارهی زیر درست است هروقت که این حد وجود داشته باشد

$\hat{J}(x_0) \leq \underset{k \to \infty}{lim} \ \hat{J}(x_{k, 0})$

اثبات

با توجه به تعریف تابعک هزینهی بهینه

$\hat{J}(x_0) = \underset{\tilde{u} \in \large{\textrm{u}}}{inf} \ \sum_{k = 0}^\infty || \begin{bmatrix} x_k \\ u_k \end{bmatrix} ||_{\tilde{R}}^2$

یک دنبالهای از کنترلها وجود دارد

$\{ u_k \}$

به طوری که

$J^{u_k}(x^0) \leq \hat{J}(x^0) + k^{-1}$, $\ k = 1, 2, ...$

بنابراین، این حد وجود دارد

$\underset{k \to \infty}{lim} \ J^{u_k}(x^0)$

و از لم ۲ استفاده میشود تا نتیجهی زیر به دست آید:

$\hat{J}(x^0) = J^{\tilde{u}}(x^0)$

حالا از رابطهی بالا اسفتاده کنید تا این دنباله را به دست آورید:

$\{ u_k \}$

که برای آن گزارهی زیر درست است

$\hat{J}(x_k^0) = J^{u_k}(x_k^0)$, $\ k = 1, 2, ...$

و نابرابری زیر

$J^u(x^0) \leq \underset{k \to \infty}{lim} \ J^{u_k}(x_k^0)$

$u \in \large{\textrm{u}}$

این نابرابری را نتیجه میدهد:

$\hat{J}(x^0) \leq \underset{k \to \infty}{lim} \ \hat{J}(x_k^0)$.

$\square$

پایداری

مفهوم «پسخور» نقش مهمی را در نظریهی سامانهها بازی میکند. به طور ویژه، یک سامانه را در نظر بگیرید

$\dot{x}(t) = A x(t) + B u(t)$

$A \in \mathbb{R}^{n \times n}$

$B \in \mathbb{R}^{n \times m}$

اگر تابع ورودی یو بر حسب متغیر تی به تابع حالت ایکس بر حسب متغیر تی وابسته باشد، سپس «پسخور حالت» به دست میآید. اگر ویژگیهای ثابت بودن در زمان و خطی بودن حفظ شوند، یک انتخاب طبیعی برای تابع تی بر حسب متغیر تی برای مثال چنین خواهد بود

$u(t) = K x(t) + v(t)$

$K \in \mathbb{R}^{m \times n}$

سپس سامانه به صورت زیر در میآید:

$\dot{x}(t) = (A + B K) x(t) + B v(t)$

تاثیر این کار تبدیل کردن ماتریس سامانهی آ به مجموع آ و حاصلضرب ب در کا بوده است و حالا سوالهایی جبری دربارهی ویژگیهای مجموع آ و حاصلضرب ب در کا به طور طبیعی پیش میآیند، که هنگامی که جفت ماتریس آ و ب ثابت شود، میتواند با انتخاب ماتریس کا به دست آید.

$A \to A + B K$

$(A, B)$

وقتی که پسخور به این صورت استفاده شود به این نکته توجه کنید که جفت نتیجه شده همان زیرفضای قابل کنترل را دارد که جفت آ و ب دارد.

$\left\{ \begin{array}{l} (A + BK, B) &\\ (A, B) \end{array} \right.$

مفهوم «ثبات پذیری» دارای دو معنی میباشد که از نظریهی سامانههای پیوسته (دیفرانسیلی) و سامانههای گسسته (تفریقی) برمیخیزد. در این دو مورد یک ماتریس ان در ان پایدار نامیده میشود هنگامی که همهی مقدارهای ویژهاش به ترتیب در نیمصفحهی باز سمت چپ باشند، یا در دیسک واحد باز باشند. هر جا که فرق گذاشتن بین این دو معنی ضروری باشد از عبارتهای پایداری پیوسته و پایداری گسسته استفاده میکنیم. با این فهم، حالا یک جفت ماتریس آ و ب را قابل پایدارشدن تعریف میکنیم اگر که یک ماتریس پسخور به نام کا وجود داشته باشد به طوری که مجموع ماتریس آ و حاصلضرب ماتریس ب در کا پایدار باشد. ما از عبارتهای پایدارشدنی پیوسته و پایدارشدنی گسسته نیز با معنیهای واضح استفاده میکنیم.

$(A, B)$

$A \in \mathbb{R}^{n \times n}$

$B \in \mathbb{R}^{n \times m}$

$A + B K$

لم ۳

اگر جفت آ و ب ثباتپذیر گسسته باشد

$(A, B)$

سپس برای تمام بردارهای اولیهی ایکس پاییننویس صفر، تابعک هزینهی بهینه متناهی است.

$\hat{J}(x_0) < \infty$

$x_0 \in \mathbb{C}^n$

اثبات

یک ماتریس به نام اف با ابعاد ام در ان وجود دارد به طوری که تفاضل زیر ثباتپذیری گسسته دارد.

$A - BF$

$F \in \mathbb{R}^{m \times n}$

کنترل پسخور زیر را در نظر بگیرید

$u_k = -F x_k$

$\{ x_k \}$

تا دنبالهی مجموعهی ایکس پاییننویس کا با رابطهی بازگشتی زیر تولید شود

$x_{k + 1} = (A- BF) x_k$, $\ k = 0, 1, 2, ...$

سپس

$\begin{bmatrix} x_k \\ u_k \end{bmatrix} = \begin{bmatrix} I \\ -F \end{bmatrix} x_k = \begin{bmatrix} I \\ -F \end{bmatrix} (A -BF)^k x_0$

به خاطر این که حاصل ماتریس آ منهای حاصلضرب بی در اف ثباتپذیر گسسته است، یک نرم وجود دارد که در آن

$||A - BF|| = \alpha < 1$

(برای مثال لم ۵.۶.۱۰ هورن و جانسون را ببینید). پس،

$||\begin{bmatrix} x_k \\ u_k \end{bmatrix}|| \leq (const.) \alpha^k$

و به سادگی نتیجه میشود که

$J(\tilde{u}, x_0) < \infty$

هرگاه که

$\hat{J}(x_0) < \infty$.

$\square$

حالا یک لم ساده دربارهی تابعک هزینه بیان میکنیم.

لم ۴

اگر ماتریس آر کلاهدار بزرگتر مساوی با صفر باشد

$\hat{R} \geq 0$

و ماتریس آر بزرگتر از صفر باشد

$R > 0$

آنگاه تصویر ماتریس اس زیرمجموعهی تصویر ماتریس کیو است.

$Im \ S \subseteq Im \ Q$

اثبات

اگر نتیجه نادرست باشد آنگاه یک بردار غیر صفر ایکس وجود دارد که متعلق به مجموعهی اشتراک تصویر ماتریس اس و فضای مکمل تصویر ماتریس کیو است که برابر است با مجموعهی اشتراک تصویر ماتریس اس و هستهی ماتریس کیو.

$x \in Im \ S \cap (Im \ Q)^\perp = Im \ S \cap Ker \ Q$

سپس

$0 \leq \begin{bmatrix} x^* & -x^* S R^{-1} \end{bmatrix} \begin{bmatrix} Q & S \\ S^* & R \end{bmatrix} \begin{bmatrix} x \\ -R^{-1} S^* x \end{bmatrix} = -x^* S R^{-1} S^* x$

همان طور که تعلق داشتن بردار ایکس به مجموعهی تصویر ماتریس اس نتیجه میدهد که بردار ایکس به هستهی مکمل ماتریس اس تعلق ندارد، داریم که

$x \in Im \ S \longrightarrow x \notin Ker \ S^*$

$x^* S R^{-1} S^* x < 0$

که در تناقض با بزرگتر از صفر بودن ماتریس آر است.

$R > 0$

$\square$

زوجهای ماتریسی کنترلپذیر

یک جفت ماتریس در نظر بگیرید

$A \in \mathbb{C}^{n \times n}$

$B \in \mathbb{C}^{n \times m}$

به طوری که حاصلضرب این دو ماتریس همیشه تعریف شده باشد.

$AB \in \mathbb{C}^{n \times m}$

یک دنباله از زیرفضاهای انبعدی مختلط بر حسب ماتریسهای آ و ب تعریف کنید

$\mathbb{C}^n$

$\mathcal{C}_0, \mathcal{C}_1, \mathcal{C}_2, ...$

$\mathcal{C}_0 = Im \ B, \mathcal{C}_1 = Im \begin{bmatrix} B & AB \end{bmatrix}, \mathcal{C}_2 = Im \begin{bmatrix} B & AB & A^2 B \end{bmatrix}, ...$

به طور استقرایی داریم

$\mathcal{C}_0 = Im \ B$

و سپس

$\mathcal{C}_{p + 1} = \mathcal{C}_p + Im(A^{p + 1} B), p = 0, 1, 2, ...$

واضح است که داریم

$\mathcal{C}_0 \subseteq \mathcal{C}_1 \subseteq \mathcal{C}_2 \subseteq ...$

ابتدا نشان میدهیم که این شمولها تا اندیس مشخصی به نام کا درست هستند (که به ماتریسهای آ و ب بستگی دارد) و پس از آن برابری به دست میآید. در هر حالت، به این دلیل که در فضای انبعدی کار میکنیم، بیشتر از ان شمول درست وجود ندارد.

گزاره ۱

اگر به ازای متغیر عدد صحیحی به نام کا تساوی زیر برقرار باشد

$\mathcal{C}_{k + 1} = \mathcal{C}$

آنگاه

$\mathcal{C}_j = \mathcal{C}_k \ for \ all \ j \geq k$.

اثبات

کافی است که ثابت کنیم

$\mathcal{C}_{k + 2} = \mathcal{C}_{k + 1}$

و نتیجه به طور استقرایی به دست میآید. بردار ایکس را تعریف کنید

$x \in \mathcal{C}_{k + 2}$

سپس برای بردارهای زیر داریم:

$x_0, x_1, ..., x_{k + 2} \in \mathbb{C}^m$

$x = \begin{bmatrix} B & AB & \ldots & A^{k + 2}B \end{bmatrix} \begin{bmatrix} x_0 \\ x_1 \\ \vdots \\ x_{k + 2} \end{bmatrix} = Bx_0 + A \begin{bmatrix} B & AB & \ldots & A^{k + 1} B \end{bmatrix} \begin{bmatrix} x_1 \\ x_2 \\ \vdots \\ x_{k + 2} \end{bmatrix}$

به خاطر اینکه

$\mathcal{C}_{k + 1} = \mathcal{C}_k$

بردارهای زیر وجود دارند

$y_1, y_2, ..., y_{k+ 1} \in \mathbb{C}^m$

به طوری که

$\begin{bmatrix} B & AB & \ldots & A^{k + 1} B \end{bmatrix} \begin{bmatrix} x_1 \\ x_2 \\ \vdots \\ x_{k + 2} \end{bmatrix} = \begin{bmatrix} B & AB & \ldots & A^k B \end{bmatrix} \begin{bmatrix} y_1 \\ y_2 \\ \vdots \\ y_{k + 1} \end{bmatrix}$

در نتیجه

$x = \begin{bmatrix} B & AB & \ldots \ A^{k + 1}B \end{bmatrix} \begin{bmatrix} x_0 \\ y_1 \\ y_2 \\ \vdots \\ y_{k + 1} \end{bmatrix} \in \mathcal{C}_{k + 1}$

بنابراین

$\mathcal{C}_{k + 2} \subseteq \mathcal{C}_{k + 1}$

و در نتیجه

$\mathcal{C}_{k + 2} = \mathcal{C}_{k + 1}$.

$\square$

کوچکترین عدد صحیح کا که برای آن گزارهی بالا صدق میکند یک مشخصهی زوج ماتریسی (آ، ب) است.

$(A, B)$

با استفاده از این مقدار کا مینویسیم

$\mathcal{C}_k = \mathcal{C}_{A, B}$

و این را «زیرفضای کنترلپذیر» زوج ماتریسی (آ، ب) مینامیم. اگر

$\mathcal{C}_{A, B} = \mathbb{C}^n$

آنگاه به زوج ماتریسی (آ، ب) کنترلپذیر گفته میشود.

به این دلیل که مقدار کا کمتر مساوی ان منهای یک است

$k \leq n - 1$

میتوانیم بنویسیم

$\mathcal{C}_{A, B} = Im \begin{bmatrix} B & AB & A^2 B & \ldots & A^{n - 1} B \end{bmatrix} = \sum_{r = 0}^{n - 1} Im(A^r B)$

از این تساوی، ویژگی تعریفکنندهی کلاسیک یک زوج ماتریسی کنترلپذیراستنتاج میشود: زوج ماتریسی (آ، ب) کنترلپذیر است اگر و فقط اگر

$rank \ \begin{bmatrix} B & AB & A^2 B & \ldots & A^{n - 1}B \end{bmatrix} = n$

$\mathbb{C}^{n \times m n}$

یعنی هنگامی که ردیفهای این ماتریس با ابعاد ان در حاصلضرب ام و ان به طور خطی مستقل باشند.

گزارهی بعدی یک مشخصهی هندسی مفید دربارهی زیرفضاهای قابل کنترل ارایه میدهد.

گزاره ۲

زیرفضای کنترلپذیر زیر

$\mathcal{C}_{A,B}$

کوچکترین زیرفضای ناوردا تحت تبدیل ماتریس آ است که شامل تصویر ماتریس ب میباشد.

$Im \ B$

اثبات

یک دنباله تعریف کنید

$\{ \mathcal{C}_r \}_{r = 0}^\infty$

و بگذارید متغیری از نوع عدد صحیح به نام کا همانند گزارهی بالا داشته باشیم. اگر

$x \in \mathcal{C}_k$

$k \in \mathbb{Z}$

معلوم است که

$Ax \in \mathcal{C}_{r + 1}$

بنابراین، اگر

$x \in \mathcal{C}_k$

آنگاه

$Ax \in \mathcal{C}_{k + 1} = \mathcal{C}_k$

و بنابراین

$\mathcal{C}_k = \mathcal{C}_{A, B}$

یک زیرفضای ناوردا تحت تبدیل ماتریس آ است. همچنین به طور بدیهی داریم

$Im \ B \subseteq \mathcal{C}_{A, B}$.

در پایان، بگذارید ماتریس اس زیرفضایی از فضای برداری انبعدی مختلط باشد

$S$

$\mathbb{C}^n$

که برای آن گزارههای زیر صادق است

$AS \subseteq S$

$Im \ B \subseteq S$

نشان خواهیم داد که

$\mathcal{C}_{A, B} \subseteq S$.

به ازای متغیر عدد طبیعی آر داریم

$r = 1, 2, ...$

$Im(A^{r - 1}B) = A^{r - 1} \ Im \ B \subseteq A^{r - 1} S \subseteq S$

$\mathcal{C}_{A, B} = Im \begin{bmatrix} B & AB & A^2B & \ldots & A^{n - 1}B \end{bmatrix} = \sum_{r = 0}^{n - 1} Im(A^rB)$

از معادلهی بالا نتیجه میشود که

$\mathcal{C}_{A, B} \subseteq S$

$\square$

روشن است که برای ماتریس ب پاییننویس ۱ و ماتریس ب پاییننویس ۲

$B_1, B_2$

که دارای تصویرهای مساوی هستند

$Im \ B_1 = Im \ B_2$

داریم

$\mathcal{C}_{A, B_1} = \mathcal{C}_{A, B_2}$.

به طور ویژه، اگر ماتریس ث بزرگتر از صفر باشد

$C > 0$

آنگاه داریم

$Im (B C B^*) = Im \ B$

یا به طور معادل داریم

$Ker(BCB^*) = Ker \ B^*$.

برای دیدن این حقیقت، مشاهده کنید که شمول زیر معلوم است

$Ker \ B^* \subseteq Ker(BCB^*)$

سپس، اگر بردار ایکس متعلق به مجموعهی هستهی حاصلضرب ماتریس ب در ث در مکمل ب باشد

$x \in Ker(BCB^*)$

داریم

$x^* BCB^* x = 0$.

ریشهی دوم معین مثبت ماتریس ث را تعریف کنید

$C^{1 / 2}$

تا به تساوی زیر برسیم

$|| C^{1 / 2} B^* x || = 0$.

بنابراین، حاصلضرب ریشهی دوم ماتریس ث در مکمل ماتریس ب برابر با صفر است

$C^{1 / 2} B^* = 0$

و چون ریشهی دوم ماتریس ث غیر تکینه است (یعنی دترمینان آن غیر صفر است)، بردار ایکس در هستهی مکمل ماتریس ب است.

$det(C^{1 / 2}) \neq 0 \longrightarrow x \in Ker \ B^*$.

در ادامه نتیجه میشود که

$Ker \ B^* = Ker(BCB^*)$.

با استفاده از این نتیجه ما به نتیجهگیری مفیدی از گزارهی قبلی میرسیم:

نتیجهگیری ۱

اگر ماتریس ث بزرگتر از صفر باشد آنگاه زوجهای ماتریسی زیر داراری یک زیرفضای کنترلپذیر مشترک هستند:

$\left\{ \begin{array}{l} (A, B) &\\ (A, BCB^*) \end{array} \right.$

به طور ویژه، زوج ماتریسی (آ، ب) کنترلپذیر است اگر و فقط اگر زوج ماتریسی (آ، حاصلضرب ب در ث در مکمل ب) کنترلپذیر باشد که در اینجا ماتریس ث بزرگتر از صفر میباشد.

$(A, B)$

$(A, BCB^*)$

$C > 0$.

حالا اجازه دهید تا به طور مختصر به خاستگاه مفهوم کنترلپذیری در نظریهی سامانهها اشاره کنیم. بگذارید ماتریسهای آ و ب به صورت زیر تعریف شوند:

$A \in \mathbb{C}^{n \times n}$

$B \in \mathbb{C}^{n \times m}$

و مسالهی مقدار اولیهی دیفرانسیلی زیر را در نظر بگیرید

$\dot{x}(t) = Ax(t) + Bu(t), \ x(0) = x_0$.

اینجا، تابع برداری یو بر حسب متغیر تی به عنوان یک تابع کنترل یا ورودی دیده میشود. به چنین دستگاهی کنترلپذیر گفته میشود اگر، به ازای هر بردار اولیهی دادهشده ایکس پاییننویس صفر، بردار پایانی ایکس پاییننویس ۱ و زمان ت بزرگتر از صفر، یک تابع کنترل پیوسته به نام یو بر حسب متغیر تی وجود داشته باشد که برای آن بردار حالت ایکس بر حسب متغیر تی مقدار ایکس پاییننویس ۱ را در زمان ت بگیرد.

$\forall x_0, \ T > 0 \longrightarrow \ \exists \ u(t), \ x(T) = x_1$

این لم توصیفی مفید از زیرفضای کنترلپذیر زوج ماتریسی (آ، ب) فراهم میکند.

لم ۵

برای هر ماتریس انبعدی مربعی شکل به نام آ، تابعهایی صحیح به نام سای بر حسب متغیر ت وجود دارند به طوری که

$A \in \mathbb{C}^{n \times n}$

$\exists \psi_1(t), \psi_2(t), ..., \psi_n(t)$

$e^{At} = \overset{n}{\underset{j = 1}{\sum}} \psi_j(t) A^{j - 1}$.

اثبات

تابع اف بر حسب متغیر لاندا را اینگونه تعریف کنید

$f(\lambda) = e^{\lambda t}$

سپس تابع اف یک تابع صحیح است (قابل تحلیل شدن در صفحهی مختصات مختلط)، بر حسب متغیر لاندا که بر روی طیف هر ماتریس ان در انی به نام آ تعریف شده است.

$A \in \mathbb{C}^{n \times n}$

چون مشتق مراتب بالاتر تابع اف اینگونه است

$f^{(j)}(\lambda) = t^j e^{\lambda t}$

از قضیهی ۱ نتیجه میشود که

$f(A) = e^{At} = \overset{s}{\underset{k = 1}{\sum}} \overset{m_{k - 1}}{\underset{j = 0}{\sum}} t^j e^{\lambda_k t} Z_{kj}$.

به خاطر این که

$Z_{kj} = \phi_{kj}(A)$

برای هر متغیر کی و جی

$k, j$

و تابع فی پاییننویس کی جی یک چندجملهای است که درجهی آن از ان بیشتر نمیشود، و زیرا تابع فی پاییننویس کی جی فقط به ماتریس آ وابسته است، عبارت سمت راست معادلهی زیر

$f(A) = e^{At} = \overset{s}{\underset{k = 1}{\sum}} \overset{m_{k - 1}}{\underset{j = 0}{\sum}} t^j e^{\lambda_k t} Z_{kj}$

را میتوان تغییر شکل داد، همانند معادلهی زیر

$e^{At} = \overset{n}{\underset{j = 1}{\sum}} \psi_j(t) A^{j - 1}$.

همچنین، هر ضریب تابع سای پاییننویس جی بر حسب متغیر ت تنها ترکیبی خطی از تابعهایی به شکل زیر هستند و بنابراین تابعهایی صحیح میباشند.

$t^j e^{\lambda_k t}$.

$\square$

قضیه ۴

بردار زد متعلق به فضای برداری انبعدی مختلط قابل دسترسی از بردار ایگرگ در فضای برداری انبعدی مختلط در مدت زمان ت میباشد اگر و فقط اگر

$z - e^{At} y \in \mathcal{C}_{A, B}$.

$y \in \mathbb{C}^n$

$z \in \mathbb{C}^n$

$t \in \mathbb{R}$

$(A, B)$

اثبات

اگر بردار زد از بردار ایگرگ در زمان ت قابل دسترسی باشد، آنگاه با استفاده از معادلهی زیر

$x(t; x_0, u) = e^{At} x_0 + \int_0^t e^{(t - s)A} Bu(s) ds$

نتیجه میگیریم که

$z - e^{At}y = \int_0^t e^{(t - s)A} Bu(s) ds$

$u \in \large{\textrm{u}}$

از لم ۷ استفاده کنید تا بنویسید

$z - e^{At}y = \overset{n}{\underset{j = 1}{\sum}} A^{j - 1}B \int_0^t \psi_j(t - s) u(s) ds$

و با تعریف زیر

$\mathcal{C}_{A, B} = \overset{n - 1}{\underset{r = 0}{\sum}} Im(A^rB)$

بلافاصله نتیجه میشود که

$z - e^{At} y \in \mathcal{C}_{A, B}$.

برای عکی قضیه، تعریف کنید

$z - e^{At}y \in \mathcal{C}_{A, B}$

باید یک ورودی (یا کنترل) به نام یو بر حسب متغیر ت بسازیم، که سامانه را از بردار ایگرگ به بردار زد «هدایت» کند. با استفاده از لم ۵ بنویسید

$z - e^{At}y = W(t) w = \int_0^t e^{As}BB^* e^{A^*s}w \ ds$

$w \in \mathbb{C}^n$

قرار دهید

$s = t - \tau$

تا معادلهی زیر را به دست بیاورید

$z - e^{At}y = \int_0^t e^{A(t - \tau)} BB^* e^{A^*(t - \tau)}w \ d \tau = \int_0^t e^{A(t - \tau)}B u(\tau) d \tau$

که در اینجا تابع یو بر حسب متغیر تاو را به صورت زیر تعریف میکنیم:

$u(\tau) = B^* e^{A^*(t - \tau)}w \in \large{\textrm{u}}$

با مقایسه کردن این و معادلهی زیر میبینیم که بردار زد از بردار ایگرگ در زمان ت قابل دسترسی است.

$x(t; x_0, u) = e^{At} x_0 + \int_0^t e^{(t - s)A} Bu(s) ds$

$\square$

لم ۶

تابع مقداردهیشده توسط ماتریس دابلیو بر حسب متغیر ت به صورت زیر تعریف شده است

$W(t) = \int_0^t e^{As} BB^* e^{A^*s}ds$

این ویژگی را دارد که برای هر مقدار متغیر ت بزرگتر از صفر

$Im \ W(t) = \mathcal{C}_{A, B}$.

$t > 0$.

اثبات

به طور روشن، تابع دابلیو یک ماتریس هرمیتی است به ازای متغیر ت بزرگتر از صفر و پس تصویر ماتریس دابلیو برابر است با مکمل متعامد هستهی خودش

$Im \ W(t) = (Ker \ W(t))^\perp$

$t > 0$

همچنین اگر عبارت زیر بیانگر زیرفضای نامشاهدهپذیر زوج ماتریسی (مکمل ب، مکمل آ) باشد

$\mathcal{K}_{A, B}$

$(B^*, A^*)$

آنگاه

$\mathcal{C}_{A, B} = (\mathcal{K}_{A, B})^\perp$.

پس، نتیجهی این لم معادل است با این گزاره

$Ker \ W(t) = \mathcal{K}_{A, B}$

و ما آن را در این شکل ثابت میکنیم.

اگر بردار ایکس در هستهی ماتریس دابلیو بر حسب متغیر ت باشد

$x \in Ker \ W(t)$

آنگاه

$x^* W(t) x = \int_0^t || B^*e^{A^*s}x ||^2 ds = 0$

در اینجا نرم بردار اقلیدسی استفاده شده است. پس، برای همهی مقادیر متغیر اس در بازهی بسته با نقطهی ابتدایی صفر و نقطهی انتهایی ت

$s \in [0, t]$

$B^*e^{A^*s}x = 0$.

از این رابطه به طور مکرر نسبت به متغیر اس مشتق بگیرید و حد آن را هنگامی که متغیر اس به سمت صفر از سمت راست نزدیک میشود محاسبه کنید تا به این نتیجه برسید

$B^*(A^*)^{j - 1} x = 0$, for $j = 1, 2, ..., n$

$s \to 0_+$

به عبارتی دیگر

$x \in \overset{n}{\underset{j = 1}{\cap}} Ker(B^*(A^*)^{j - 1}) = \mathcal{K}_{A, B}$.

پس هستهی ماتریس دابلیو بر حسب متغیر تی متعلق به زیرفضای نامشاهدهپذیر زوج ماتریسی (آ، ب) میباشد.

$Ker \ W(t) \subset \mathcal{K}_{A, B}$

$(A, B)$

به آسانی بررسی میشود که با برعکس کردن این ادعا و با استفاده از لم ۷، عکس شمول به دست میآید. پس، هستهی ماتریس دابلیو بر حسب متغیر ت برابر است با زیرفضای نامشاهدهپذیر زوج ماتریسی (آ، ب) و این لم اثبات شد.

$Ker \ W(t) = \mathcal{K}_{A, B}$.

$\square$

این لم معیار دیگری را برای کنترلپذیری زوج ماتریسی (آ، ب) نتیجه میدهد.

نتیجهگیری ۲

زوج ماتریسی (آ، ب) کنترلپذیر است اگر و فقط اگر ماتریس دابلیو بر حسب متغیر ت معین مثبت باشد به ازای همهی مقدارهای بزرگتر از صفر برای متغیر ت.

$(A, B)$

$t > 0$

این لم معیار دیگری را برای کنترلپذیری زوج ماتریسی (آ، ب) نتیجه میدهد.

اثبات

از روی تعریف تابع ماتریسی دابلیو بر حسب متغیر ت واضح است که ماتریس دابلیو دستکم شبهمعین مثبت است. اما، این که زوج ماتریسی (آ، ب) کنترلپذیر باشد یعنی زیرفضای کنترلی زوج ماتریسی (آ، ب) برابر باشد با فضای برداری انبعدی مختلط.

$W(t) = \int_0^t e^{As} BB^* e^{A^*s}ds$

$W(t) \geq 0$

$\mathcal{C}_{A, B} = \mathbb{C}^n$